Cloud-Transkription ist tot. Sie weiß es nur noch nicht.

Zwei Jahre lang haben Cloud-Dienste den Markt dominiert, weil nur Server große Modelle ausführen konnten. Diese Ära ist vorbei. Heute verarbeitet ein MacBook Whisper Large-v3 Turbo (809 Millionen Parameter) schneller als jede Cloud-API—und Ihr iPhone transkribiert vollständig offline.

Dieser Artikel erklärt, warum lokale Verarbeitung Cloud-Transkription in jeder wichtigen Metrik übertroffen hat. Nicht Marketing—Ingenieurwissenschaft.

Whisper Notes: Professionelle Offline-Transkription

Das Latenzproblem

Cloud-Transkription hat eine physikalische Untergrenze: Audio-Upload + Server-Warteschlange + Modell-Inferenz + Ergebnis-Download. Das sind typischerweise 2-4 Sekunden unter idealen Netzwerkbedingungen. Bei schlechtem Signal werden es 10+ Sekunden.

Lokale Inferenz eliminiert diese Variablen. Whisper Large-v3 Turbo auf Apple Silicon erreicht nahezu Echtzeit-Streaming—Transkription während Sie sprechen. Kein Upload, kein Netzwerk-Jitter, keine Warteschlange.

Unsere Messungen: Ein M1 MacBook Air verarbeitet 10 Minuten Audio in 63 Sekunden. Das ist nicht Spitzenleistung—das ist nachhaltiger, reproduzierbarer Durchsatz.

Das Hardware-Mietproblem

Cloud-Transkriptionsdienste berechnen nach Nutzung oder monatlich. Das erscheint fair, bis Sie rechnen.

Abos schaffen eine seltsame Psychologie. Sie zögern, lange Meetings aufzunehmen. Sie machen weniger Sprachmemos. Die Nutzungsabrechnung führt zu Selbstzensur.

Der Einmalkauf entfernt diese Barriere. Ob Sie 10 Minuten oder 10 Stunden pro Monat aufnehmen—die Kosten sind identisch: null.

Das Datenleck-Problem

Die meisten Cloud-Dienste haben Datenschutzrichtlinien, die versprechen, Ihre Daten zu schützen. Aber Architektur macht Richtlinien irrelevant.

Sobald Ihr Audio übertragen wird, verlieren Sie die Kontrolle. Es kann protokolliert, gecached, für Training verwendet werden. Selbst bei besten Absichten sind Serverdaten eine Angriffsfläche.

Lokale Verarbeitung eliminiert diese Fläche. Ihre Aufnahmen verlassen niemals das Gerät. Keine Übertragungsprotokolle, kein Serverspeicher, keine Möglichkeit für Dritten-Zugriff.

Für Ärzte, Anwälte, Journalisten—jeden mit Vertraulichkeitspflichten—ist das nicht nur bequem. Es ist eine Notwendigkeit.

Der Genauigkeits-Tradeoff

Ein verbreitetes Missverständnis: Größere Cloud-Modelle bedeuten höhere Genauigkeit. Das stimmt nicht mehr.

Whisper Large-v3 Turbo ist ein destilliertes Modell—es lernt vom vollständigen Large-v3 und behält die Genauigkeit bei 4-5x Geschwindigkeit. Auf Standard-Benchmarks erreicht es vergleichbare Wortfehlerraten.

Wichtiger: Whispers 680.000 Stunden Trainingsdaten decken praktisch jedes Szenario ab. Meetings, Vorlesungen, Sprachmemos—alles liegt in seinen Fähigkeiten.

Geschwindigkeits-Benchmarks

Konkrete Zahlen für 10 Minuten Audio:

Bemerkenswert: Lokale Geschwindigkeit ist konstant. Keine Variation durch Netzwerk, keine Warteschlangen, keine Peak-Verzögerung.

Vollständig offline: Audio importieren, direkt transkribieren

Praktische Umsetzung

Die besten Tools sind die, die verschwinden. Unsere Design-Entscheidungen:

Sperrbildschirm-Widget

Wertvolle Aufnahmen entstehen plötzlich—Geistesblitze, spontane Gespräche, unerwartete Anrufe. Telefon entsperren, App suchen, Aufnahme starten—jeder Schritt ist eine verpasste Gelegenheit. Ein-Tap-Aufnahme vom Sperrbildschirm beseitigt diese Barriere.

Direkt vom Sperrbildschirm aufnehmen

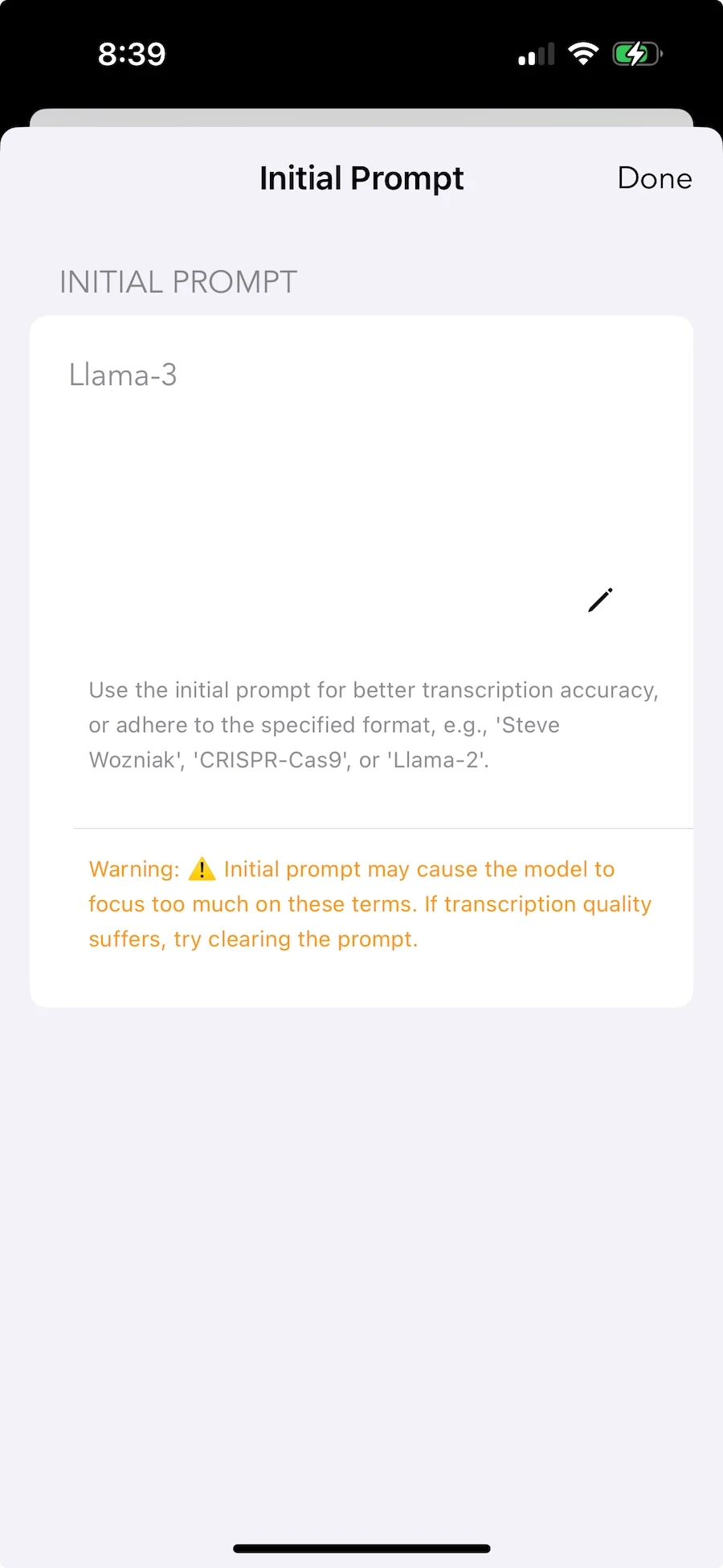

Initial Prompts (Fachvokabular)

Jedes Fach hat Begriffe, die Whisper nicht standardmäßig erkennt. Medizinische Terminologie, juristische Ausdrücke, Firmennamen, technische Abkürzungen. Initial Prompts teilen dem Modell mit: "Diese Wörter werden vorkommen, bitte korrekt erkennen."

Fachbegriffe konfigurieren für höhere Genauigkeit

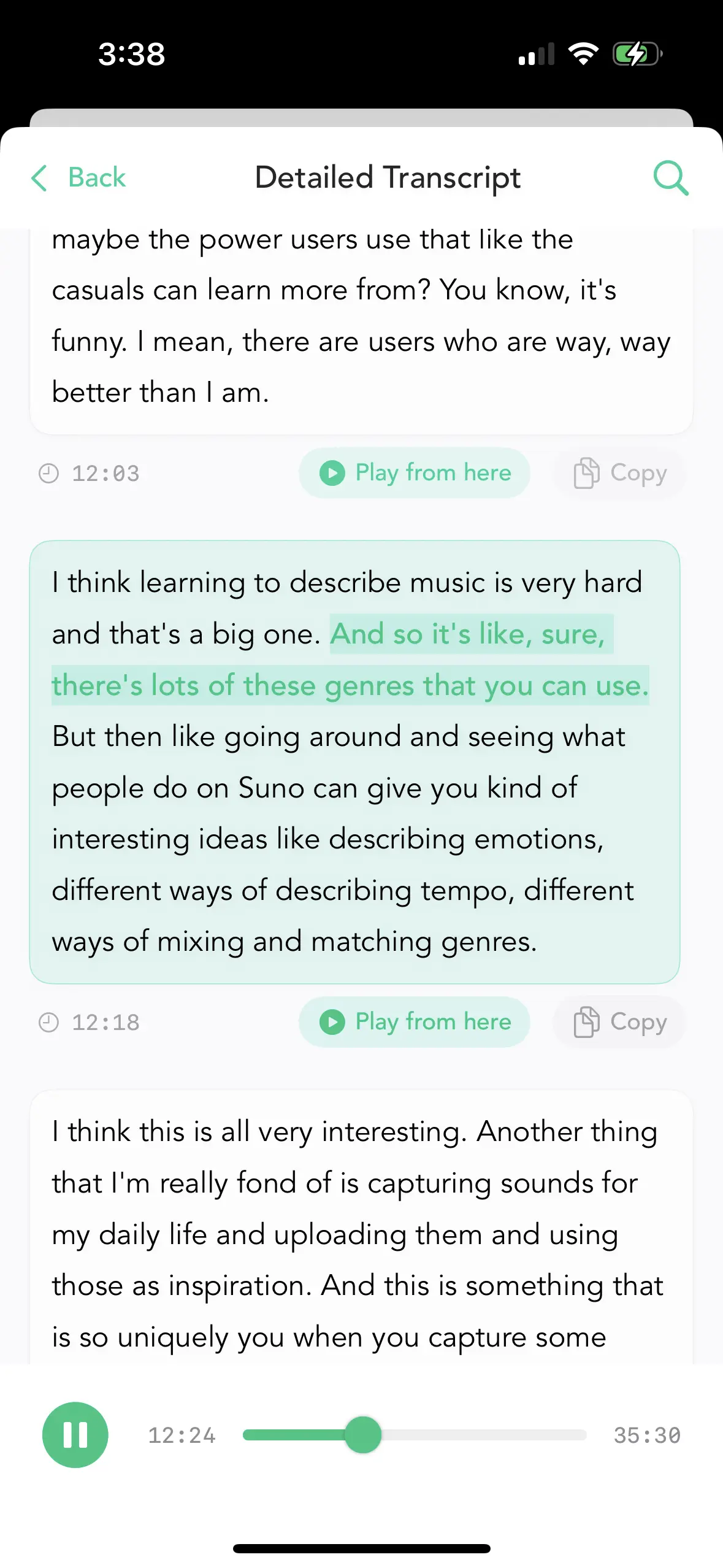

Zeitstempel-Navigation

Der Wert langer Aufnahmen liegt oft in bestimmten Segmenten. Ohne Zeitstempel müssen Sie alles anhören, um einen Satz zu finden. Mit anklickbaren Zeitstempeln springen Sie direkt zum relevanten Teil.

Zeitstempel für präzise Navigation

Massen-Export

Forscher, Journalisten, Anwälte verarbeiten oft Dutzende Aufnahmen. Einzelexport ist inakzeptabel. Massen-Operationen machen professionelle Workflows praktikabel.

Massen-Auswahl, alles auf einmal exportieren

Wann Cloud besser ist

Ehrliche Einschätzung—Cloud-Lösungen haben noch ihren Platz:

Für persönliche Aufnahmen, Meetings, Sprachmemos, Interviews—die Mehrheit der realen Nutzung—ist lokal bei Latenz, Datenschutz und Kosten überlegen.

Die Trajektorie

Hardware wird weiter besser. Apple Silicon verbessert die Neural Engine jährlich um ~30%. Das bedeutet: größere Modelle werden lokal ausführbar, höhere Geschwindigkeiten für bestehende Modelle.

Wir haben Whisper Notes gebaut, weil lokale Inferenz für Sprachtranskription in jeder wichtigen Metrik gewonnen hat—Latenz, Datenschutz, Kosten, Zuverlässigkeit. Das ist keine Ideologie. Das ist Ingenieurwissenschaft.

Technische Details

Geräteanforderungen: iPhone 12+ (A14-Chip) oder Mac mit M-Serie-Chip.

Modelle: Parakeet V3 (103x Echtzeit, 6,32% WER für Englisch). SenseVoice Small (52x Echtzeit für Chinesisch, Japanisch, Koreanisch, Kantonesisch). Whisper Large V3 Turbo (100+ Sprachen). Alle drei laufen lokal auf dem Mac.

Geschwindigkeit: Parakeet V3: 35 Min. Audio in 20 Sekunden auf M4 Pro. SenseVoice: 27 Min. chinesischer Podcast in 14 Sekunden. Whisper Turbo: 35 Min. in ~3 Minuten.

KI-Bearbeitung: On-Device Gemma 4 korrigiert Zeichensetzung, entfernt Füllwörter (äh, ähm), generiert Titel und beantwortet Fragen zu Ihrem Transkript.

Preis: $6.99 einmalig. Kostenlose Testversion auf Mac. Kein Abo, weil wir keine Server betreiben.

Häufig gestellte Fragen

Kann man ohne Internetverbindung transkribieren?

Ja. Whisper Notes ist eine Offline-Transkriptionssoftware, die vollständig auf Ihrem Gerät läuft. Alle drei KI-Modelle — Parakeet V3, SenseVoice und Whisper — verarbeiten Audio lokal über die Neural Engine Ihres Mac oder den A-Serie-Chip Ihres iPhone. Keine Daten werden hochgeladen, kein Server wird kontaktiert. Sie können es selbst testen, indem Sie den Flugmodus aktivieren.

Funktioniert OpenAI Whisper offline?

Ja. OpenAI hat Whisper als Open-Source-Modell veröffentlicht, was bedeutet, dass es lokal auf Ihrer Hardware laufen kann. Whisper Notes paketiert Whisper Large V3 Turbo für Apple Silicon über CoreML/Metal — kein Python, keine Kommandozeile, kein Internet erforderlich. Es unterstützt 100+ Sprachen mit Offline-Spracherkennung.

Ist Whisper Notes für Windows oder Android verfügbar?

Noch nicht. Whisper Notes unterstützt derzeit Mac (M-Serie) und iPhone (12+). Für Windows sind faster-whisper (Kommandozeile) oder Buzz (GUI-Wrapper) Alternativen. Wir werden möglicherweise in Zukunft weitere Plattformen unterstützen, aber Apple Silicons Neural Engine bietet Mac-Nutzern derzeit die beste lokale Sprache-zu-Text-Erfahrung.

Gibt es eine kostenlose Offline-Transkriptions-App?

Whisper Notes bietet eine kostenlose Testversion auf Mac — laden Sie die DMG herunter und probieren Sie es ohne Zeitlimit. Der vollständige Kauf kostet $6.99 einmalig (kein Abo). Zum Vergleich: Cloud-Transkriptionsdienste wie Otter.ai kosten $10-20/Monat. Über drei Jahre sind das $360-720 gegenüber $6.99 einmalig.

Wie vergleicht sich Whisper Notes mit MacWhisper oder faster-whisper?

MacWhisper ist ein reines Mac-Whisper-Frontend. faster-whisper ist ein Kommandozeilen-Tool. Whisper Notes enthält drei Modelle (Parakeet V3, SenseVoice, Whisper), unterstützt sowohl Mac als auch iPhone, bietet systemweites Fn-Tasten-Diktat, Sperrbildschirm-Widgets, On-Device-KI-Bearbeitung und Massen-Export — alles für $6.99 einmalig.