OpenAIs Whisper Large-v3 Turbo reduziert den Decoder von 32 auf 4 Schichten und senkt die Parameterzahl von 1,55 Mrd. auf 809 Mio. Das Ergebnis: 2-5× schnellere Transkription bei nahezu identischer Genauigkeit. Whisper Notes liefert es auf dem Mac mit Apple Silicon.

V3 Turbo vs V3: Was sich geaendert hat

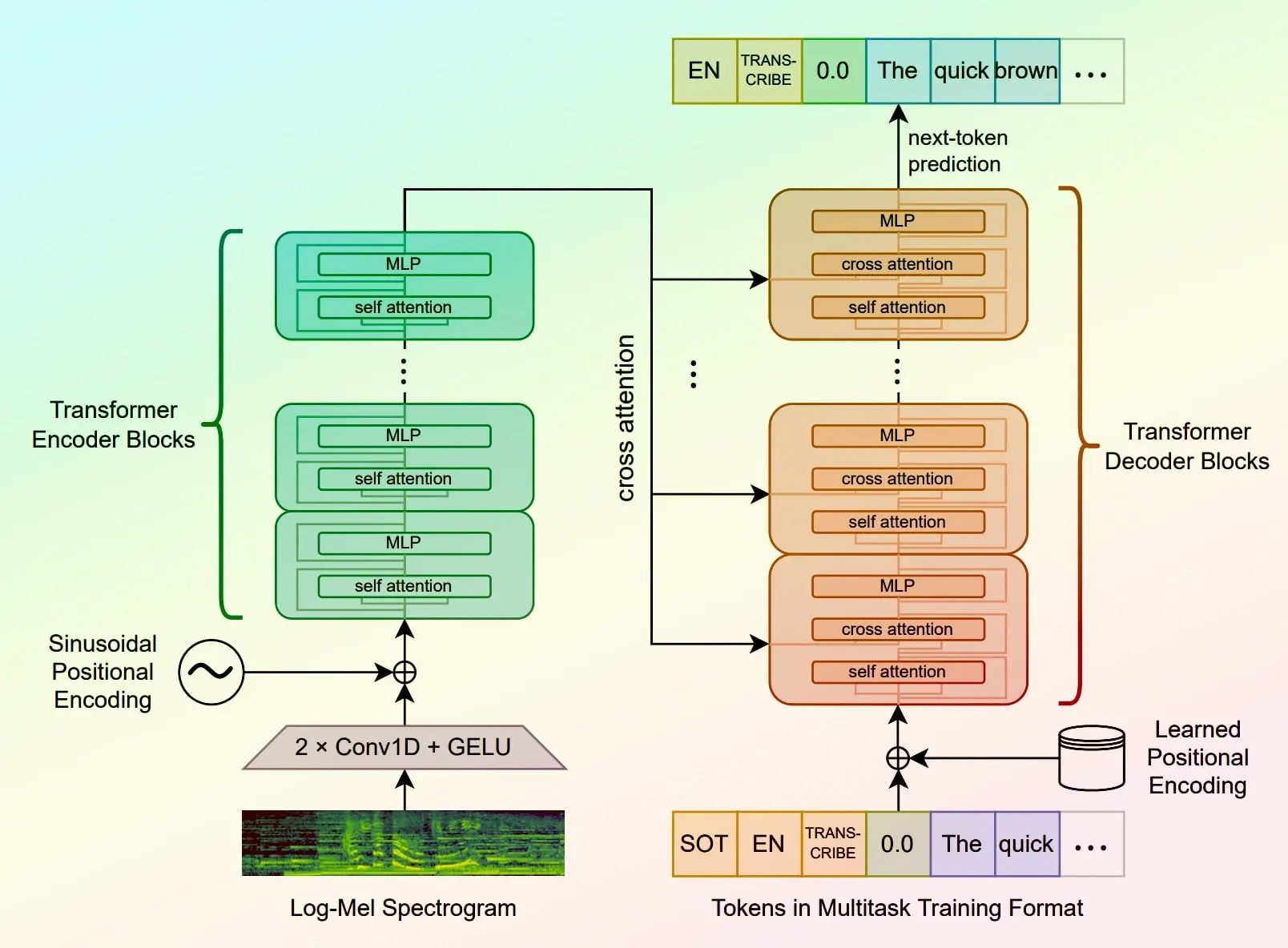

Turbo ist keine neue Architektur. Es ist exakt dasselbe Whisper Large-v3 Modell, bei dem der Decoder von 32 auf 4 Schichten beschnitten und anschliessend feingetunt wurde, um die Genauigkeit wiederherzustellen. Der Encoder ist unveraendert.

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| Parameter | 809M | 1,550M |

| Decoder-Schichten | 4 | 32 |

| Sprachen | 99 | 99 |

| Uebersetzungsaufgabe | Nicht unterstuetzt | Unterstuetzt |

| Lizenz | MIT | Apache 2.0 |

Die Uebersetzungsaufgabe wurde explizit aus Turbos Trainingsdaten ausgeschlossen. Das vollstaendige Large-v3 Modell unterstuetzt sie, aber Whisper Notes liefert nur Turbo -- die Uebersetzung wird separat ueber Apple Intelligence abgewickelt.

Geschwindigkeits-Benchmark: Whisper Notes auf Apple Silicon

In Whisper Notes fuer Mac laeuft Turbo ueber CoreML auf der Neural Engine. Verarbeitung von 10 Minuten Audio:

| Geraet | Whisper V3 | V3 Turbo | Beschleunigung |

|---|---|---|---|

| iPhone 15 Pro | 425 s | 82 s | 5.2× |

| iPad Pro M2 | 380 s | 71 s | 5.4× |

| MacBook Pro M2 | 316 s | 63 s | 5.0× |

Die 5-fache Beschleunigung gilt speziell fuer Whisper Notes auf Apple Silicon, wo der kleinere Decoder von der Neural Engine-Optimierung profitiert. Auf GPU mit Frameworks wie faster-whisper verringert sich der Abstand auf ca. 2,7× (siehe Community-Benchmarks unten).

Genauigkeit: WER-Vergleich

Das Hugging Face Open ASR Leaderboard testet beide Modelle auf denselben englischen Datensaetzen. Turbos Wortfehlerrate liegt bei jedem Benchmark innerhalb eines halben Prozentpunkts von V3:

| Datensatz | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| Durchschnittliche WER | 7.83% | 7.44% |

V3 ist bei jedem Datensatz etwas genauer, aber der Unterschied ist gering -- durchschnittlich 0,39 Prozentpunkte. Bei den meisten realen Transkriptionen ist der Unterschied nicht spuerbar.

Bei der YouTube-commons Langform-Evaluation (einem der groessten Open-Source-ASR-Benchmarks) erreicht Turbo 13,40% WER gegenueber 13,20% bei V3 -- bei einem Echtzeit-Faktor von 129,5× gegenueber 55,3×. Das ist 2,3× schneller bei nahezu identischer Genauigkeit auf realen Audiodaten.

Community-Benchmarks: GPU & CPU

Unabhaengige Benchmarks aus den faster-whisper und whisper.cpp Communities zeigen konsistente Ergebnisse ueber verschiedene Hardware. Transkription von 13 Minuten Audio mit faster-whisper auf GPU:

| Modell | Praezision | Zeit | GPU-Speicher | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 s | 2,537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 s | 4,521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 s | 1,545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 s | 2,409 MB | 2.39% |

Quelle: faster-whisper Benchmark auf NVIDIA GPU, LibriSpeech clean Validierungssplit. Turbo int8 benoetigt nur 1,5 GB VRAM -- laeuft auch auf einer 2-GB-GPU.

Batch-Inferenz auf einem RTX 3060 Laptop (6 GB VRAM, int8 Praezision) verstaerkt den Vorteil weiter:

| Modell | Sequentiell | Batch (10) | Batch-WER |

|---|---|---|---|

| Large-v3 Turbo | 46.1 s | 18.7 s | 7.7% |

| Large-v3 | 230.8 s | 43.0 s | 7.9% |

| Large-v2 | 178.3 s | 43.2 s | 8.8% |

| Medium | 113.3 s | 26.3 s | 8.9% |

Quelle: NilaierMusic Benchmark, Intel i7-12650H + RTX 3060 Laptop 6 GB, franzoesisches Audio, int8 Praezision.

Mit Batch-Verarbeitung erzielt Turbo die beste WER aller getesteten Modelle (7,7%) und ist gleichzeitig das schnellste. Der klare Sweet Spot fuer den Produktionseinsatz.

Bekannte Einschraenkungen (und wie Whisper Notes damit umgeht)

Keine integrierte Uebersetzung

Turbo wurde ohne Uebersetzungsdaten trainiert. Es transkribiert nur in der Ausgangssprache -- im Gegensatz zu Large-v3, das Audio-zu-Englisch-Uebersetzung unterstuetzt.

Whisper Notes -- Apple Intelligence uebersetzt Transkripte automatisch in Ihre gewaehlte Sprache und liefert zweisprachige Ausgabe, unabhaengig vom verwendeten Modell.

Mehr Halluzinationen bei verrauschtem Audio

Community-Berichte zeigen, dass Turbo bei sehr kurzen Clips oder verrauschten Aufnahmen mehr halluziniert als V3. Angesichts des reduzierten Decoders (4 Schichten vs 32) zu erwarten.

Whisper Notes -- fuehrt vor der Transkription Pyannote VAD aus, erkennt Sprachsegmente und entfernt Stille/Rauschen, damit das Modell nur echte Stimme verarbeitet.

Welches Modell sollten Sie verwenden?

| Englisch / Europaeisch | Parakeet V3 -- 10× schneller als Whisper, bessere Genauigkeit |

| Chinesisch / Japanisch / Koreanisch | SenseVoice -- speziell fuer CJK entwickelt, 52-fache Geschwindigkeit |

| Andere Sprachen | Whisper Large V3 Turbo -- 99 Sprachen, hohe Genauigkeit, langsamer |