Wir haben Offline-Meeting-Transkription für den Mac gebaut. Es nimmt Zoom-, Teams- und Google Meet-Anrufe auf, transkribiert sie lokal mit Parakeet V3 und fasst sie mit Gemma 4 zusammen. Keine Cloud, kein Bot im Anruf. Einmalig $6.99.

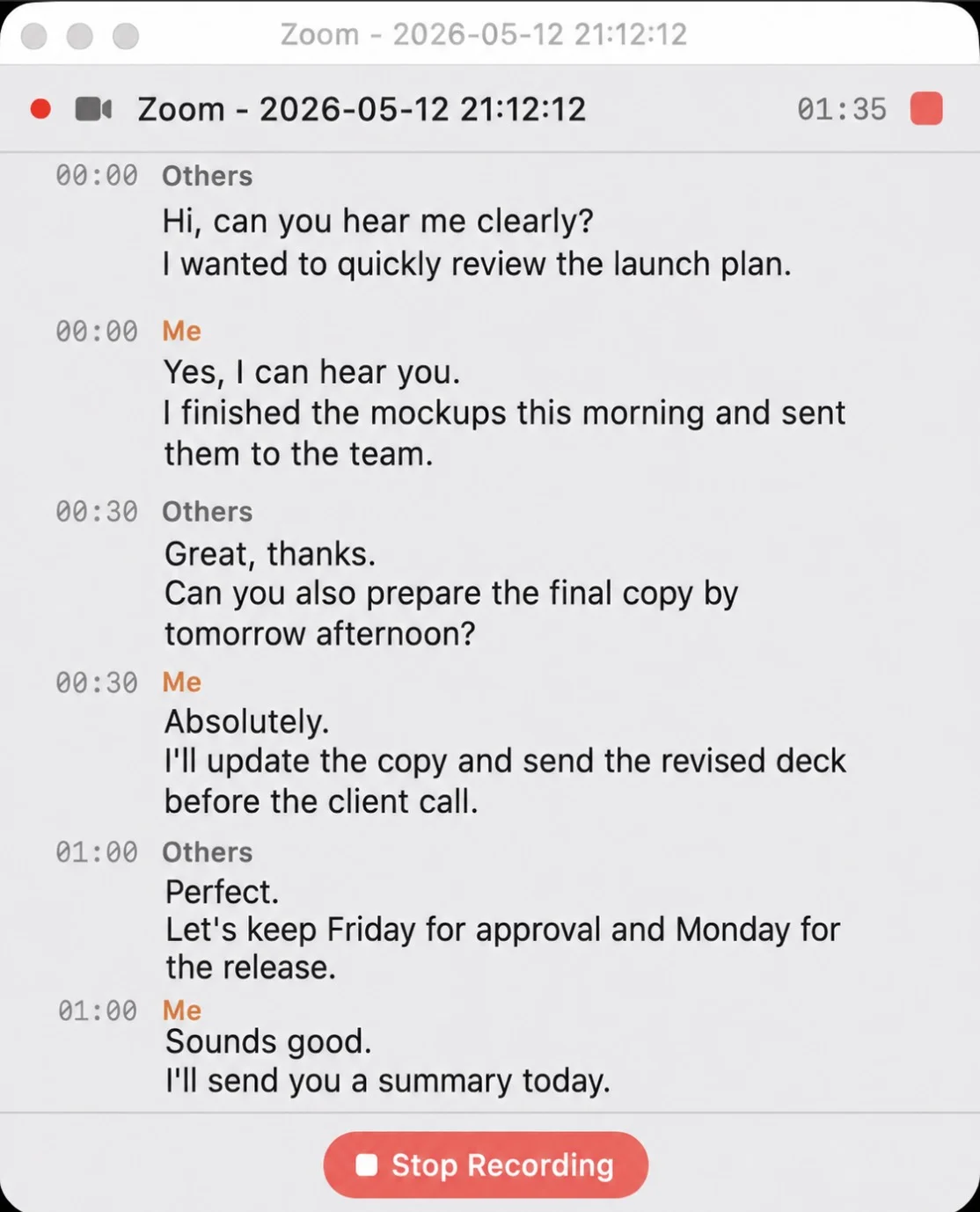

Aufnahme eines Zoom-Anrufs in Whisper Notes — „Ich" und „Andere" werden nach Audioquelle gekennzeichnet

Ein typischer Montag

10 Uhr, Zoom-Call mit einem Kunden. Du öffnest Whisper Notes, klickst auf Aufnahme. Die App erfasst gleichzeitig System-Audio und dein Mikrofon — niemand im Meeting sieht einen Bot, niemand bekommt eine Benachrichtigung, nichts taucht in der Teilnehmerliste auf.

Eine Stunde später endet der Call. Du stoppst die Aufnahme. Parakeet V3 transkribiert 60 Minuten Audio in etwa einer Minute, komplett auf der Neural Engine deines Macs. Du tippst auf Zusammenfassen — Gemma 4 extrahiert die Kernpunkte. Du tippst auf Aufgaben — es zieht jede Aufgabe und jede Frist heraus. Du schickst die Meeting-Notizen an den Kunden. Das Audio hat deinen Rechner nie verlassen.

Das ist der gesamte Workflow. Aufnehmen, transkribieren, zusammenfassen. Alles lokal.

Was es kann

Aufnahme

Whisper Notes erfasst System-Audio — den Ton, der aus deinen Lautsprechern oder Kopfhörern kommt. Wenn du es am Mac hören kannst, können wir es transkribieren. Zoom, Teams, Google Meet, Webex, GoTo, Whereby, Jitsi, YouTube, Podcasts oder jede andere App. Gleichzeitig wird dein Mikrofon aufgenommen, sodass beide Seiten des Gesprächs erfasst werden.

Kein Bot tritt dem Anruf bei. Das ist wichtiger, als es klingt. Wenn du schon einmal „Otter.ai Notetaker has joined the meeting" in einem Zoom-Call aufpoppen gesehen hast, weißt du, was dann passiert — jemand fragt, was das ist, jemand anderem wird es unangenehm, und das Gespräch kippt. Mit System-Audio-Erfassung weiß niemand, dass du aufnimmst, außer du selbst.

Transkription

Parakeet V3 läuft über CoreML auf Apple Silicon. Es verarbeitet Englisch und 24 europäische Sprachen mit etwa 60-facher Echtzeit-Geschwindigkeit — ein 60-Minuten-Meeting ist in etwa einer Minute fertig. Für Chinesisch, Japanisch oder Koreanisch übernimmt SenseVoice CJK mit 52-facher Geschwindigkeit. Pyannote VAD entfernt Stille vor der Transkription, sodass das Modell nur tatsächliche Sprache verarbeitet.

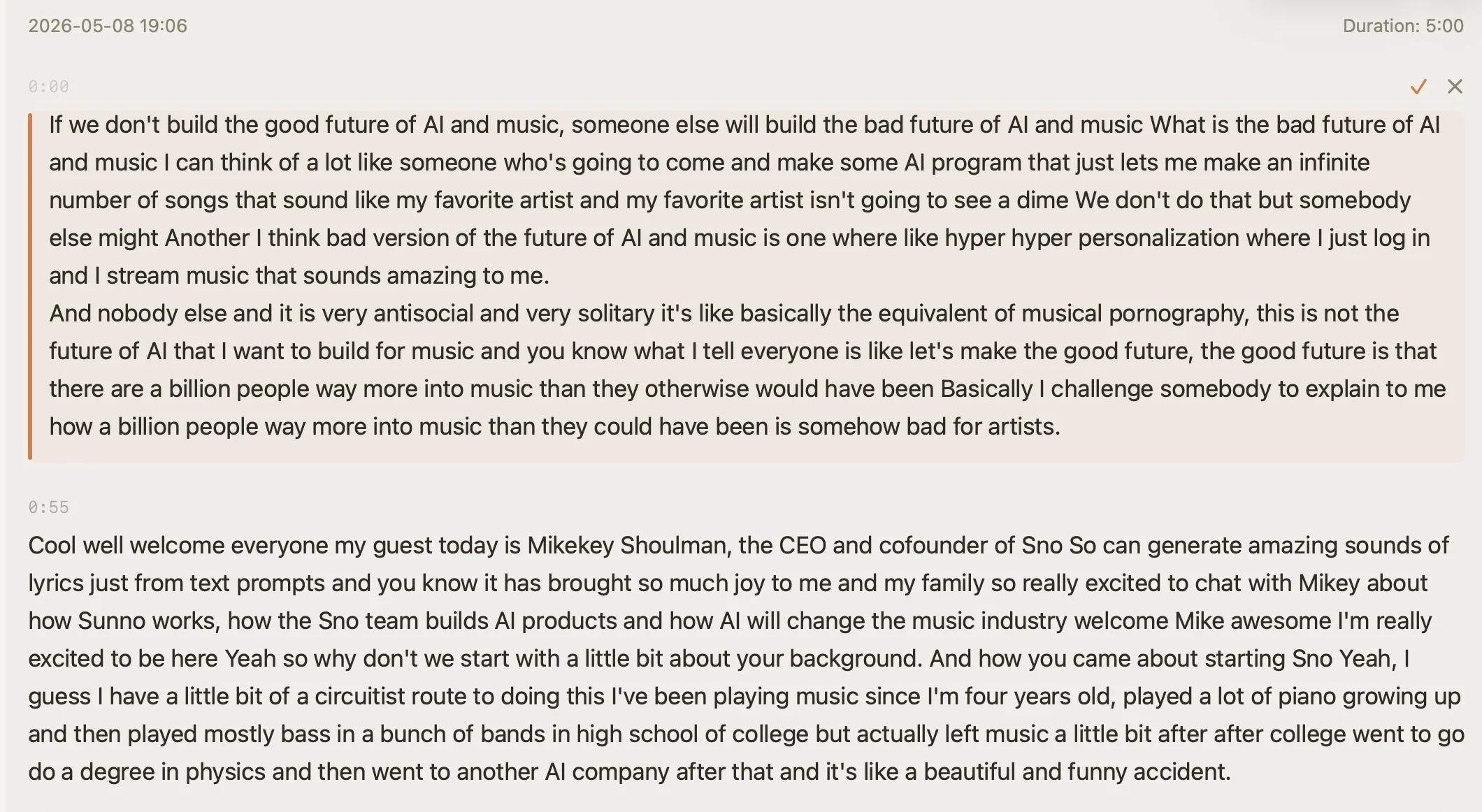

Transkript mit Zeitstempeln und Inline-Bearbeitung — klicke auf ein Segment, um zu dieser Stelle im Audio zu springen

KI-Funktionen — alles lokal

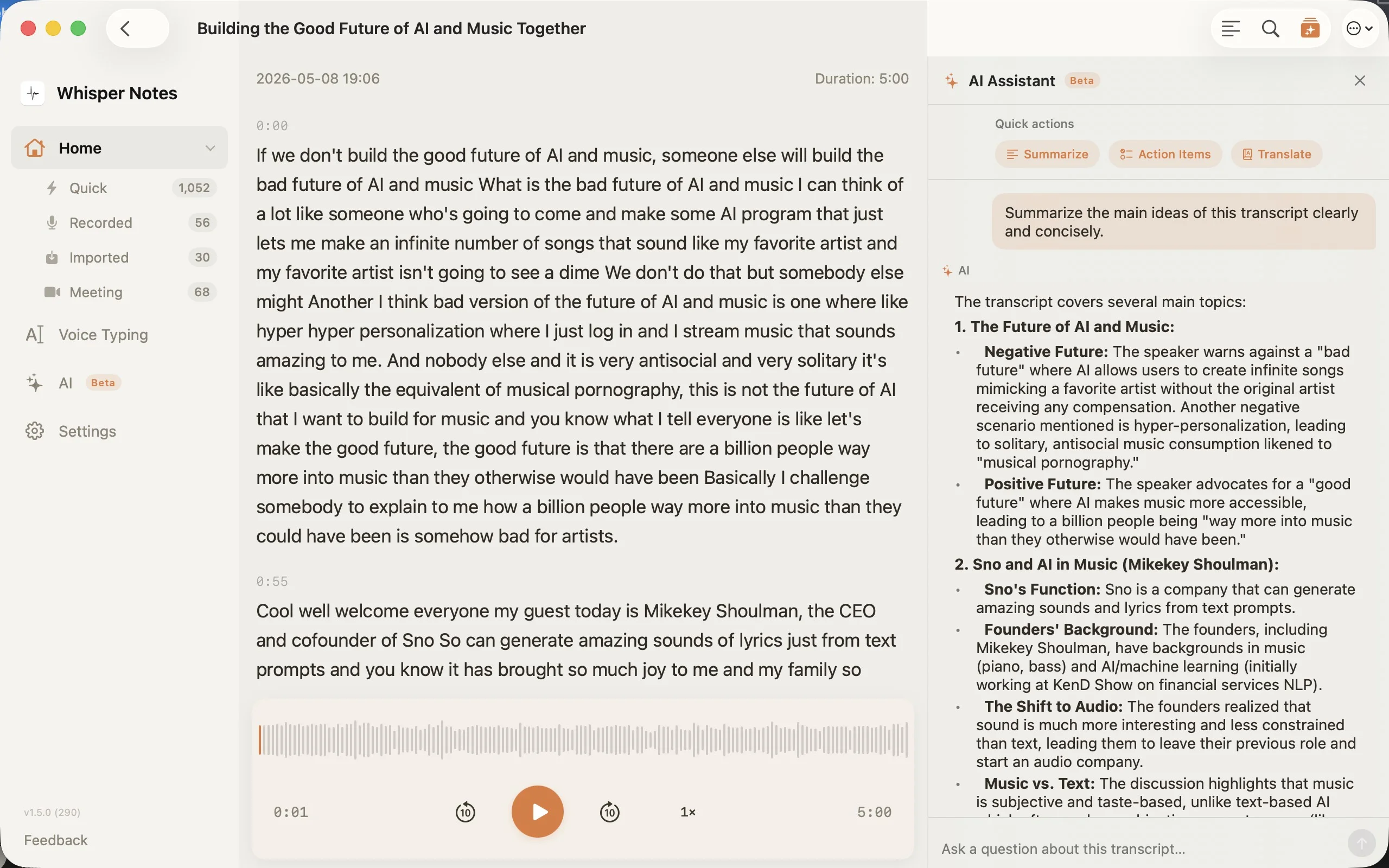

Gemma 4 läuft auf deinem Mac. Kein API-Key, kein Cloud-Aufruf, keine Nutzungslimits. Nach der Transkription:

- •Zusammenfassen — Kernpunkte eines 60-Minuten-Meetings, in Sekunden

- •Aufgaben — Tasks und Fristen, automatisch extrahiert

- •Übersetzen — Apple Intelligence übersetzt das Transkript in eine andere Sprache

- •Chat — frag „Was haben wir beim Preis vereinbart?" und bekomme eine Antwort basierend auf dem Transkript

Gemma 4 KI-Seitenleiste — Zusammenfassen, Aufgaben, Übersetzen und freier Chat, alles lokal

Warum wir es so gebaut haben

Meeting-Audio gehört zu den sensibelsten Daten, die ein Unternehmen produziert. Kundenverhandlungen, HR-Gespräche, Vorstandsdiskussionen, Rechtsberatungen — die Art von Gesprächen, bei denen ein einziges Leck Karrieren beenden kann.

Die meisten Transkriptionstools laden dieses Audio auf Cloud-Server hoch, verarbeiten es dort und speichern es gemäß ihren Datenspeicherungsrichtlinien. Manche fügen dem Anruf einen Bot hinzu, den alle sehen können. Manche speichern deine Aufnahmen unbegrenzt für „Modellverbesserung".

Wir haben einen anderen Ansatz gewählt: Alles läuft auf deinem Mac. Das ASR-Modell, das LLM, die Audio-Speicherung — alles lokal. Es gibt keinen Server, der gehackt werden kann, keine Datenspeicherungsrichtlinie, die man lesen muss, kein Risiko einer Herausgabeanordnung an Dritte. Für Teams unter GDPR, HIPAA oder Anwaltsgeheimnis ist diese Architektur der entscheidende Punkt.

Vergleich

| Whisper Notes | Otter.ai | Fireflies | Jamie | |

|---|---|---|---|---|

| Verarbeitung | 100 % on-device | Cloud | Cloud | Hybrid |

| Bot im Anruf | Nein | Ja | Ja | Nein |

| Preis | Einmalig $6.99 | $16.99/mo (Pro) | from $18/mo | $24/mo |

| Offline nutzbar | Ja | Nein | Nein | Teilweise |

| KI-Zusammenfassung | Lokal (Gemma 4) | Cloud | Cloud | Cloud |

| Sprechertrennung | Noch nicht | Ja | Ja | Ja |

Verschiedene Meetings, verschiedene Sprachen

Wähle das Modell passend zur Meeting-Sprache:

| Englisch / Europäisch | Parakeet V3 — ~60-fache Echtzeit, 6.32 % WER, keine Halluzinationen bei Stille |

| Chinesisch / Japanisch / Koreanisch | SenseVoice — 52-fach, Kantonesisch, GPU-beschleunigt über MLX |

| Andere Sprachen | Whisper Large V3 Turbo — 99 Sprachen, hohe Genauigkeit, langsamer |

Was noch fehlt

Sprechertrennung gibt es noch nicht. Aktuell kennzeichnet Whisper Notes Audio als „Ich" (dein Mikrofon) und „Andere" (System-Audio) — das reicht für die meisten Einzelgespräche und kleine Meetings. Aber bei einem 10-Personen-Call, in dem man wissen muss, wer was gesagt hat, reicht das nicht.

Das ist der offensichtliche nächste Schritt, und wir arbeiten daran. Das Ziel ist lokale Sprechertrennung, die neben Parakeet V3 und SenseVoice läuft, ohne Audio irgendwohin zu senden.