El Whisper Large-v3 Turbo de OpenAI reduce el decoder de 32 capas a 4, bajando los parametros de 1.55B a 809M. El resultado: transcripcion 2-5× mas rapida con precision casi identica. Whisper Notes lo incluye en Mac con Apple Silicon.

V3 Turbo vs V3: que cambio

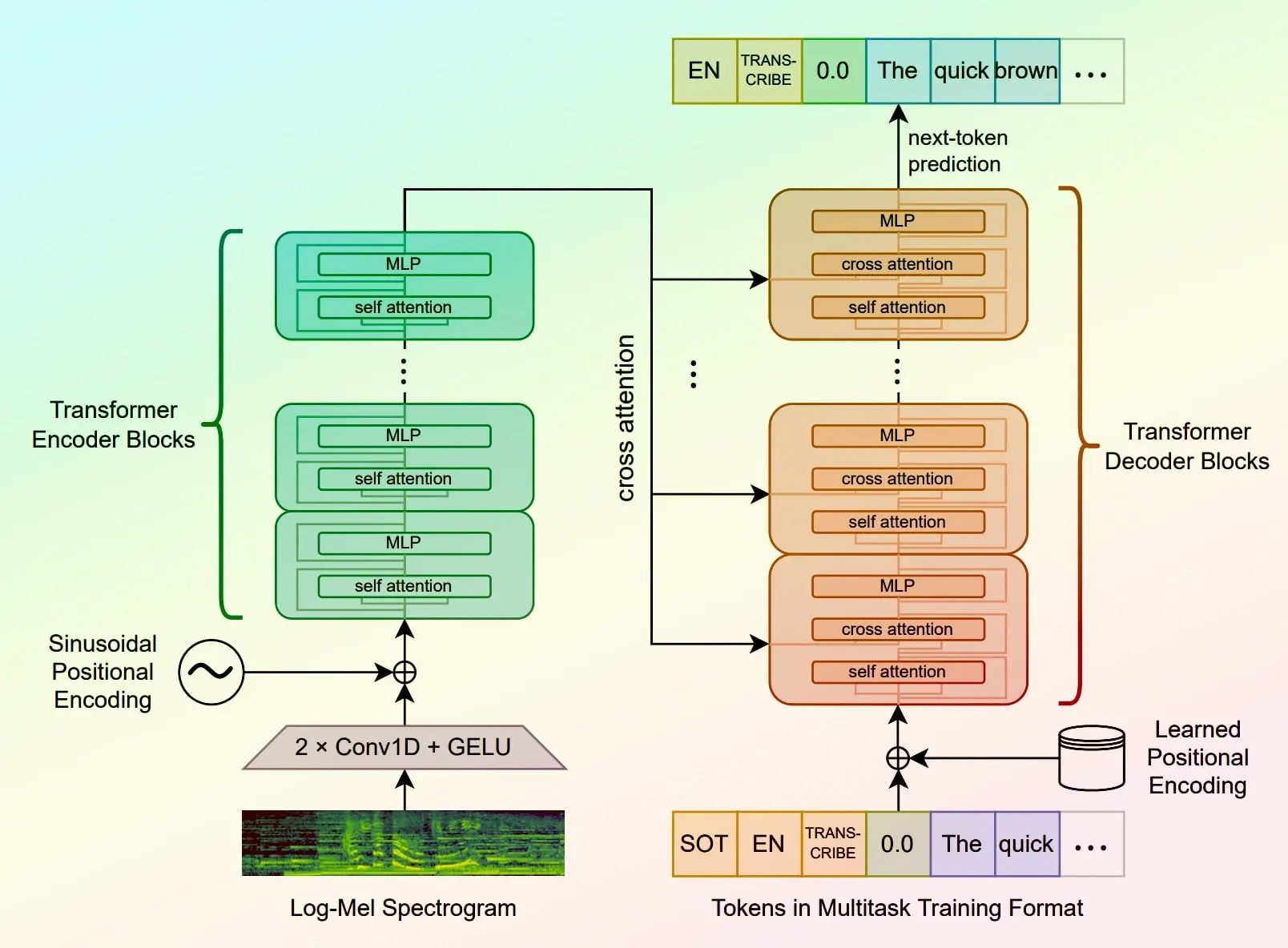

Turbo no es una arquitectura nueva. Es exactamente el mismo modelo Whisper Large-v3 con el decoder podado de 32 capas a 4, y luego ajustado (fine-tuned) para recuperar la precision. El encoder no se toca.

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| Parametros | 809M | 1,550M |

| Capas del decoder | 4 | 32 |

| Idiomas | 99 | 99 |

| Tarea de traduccion | No soportada | Soportada |

| Licencia | MIT | Apache 2.0 |

La tarea de traduccion fue excluida explicitamente de los datos de entrenamiento de Turbo. El modelo completo Large-v3 la soporta, pero Whisper Notes solo incluye Turbo — la traduccion se maneja por separado via Apple Intelligence.

Benchmark de velocidad: Whisper Notes en Apple Silicon

En Whisper Notes para Mac, Turbo funciona via CoreML en el Neural Engine. Procesando 10 minutos de audio:

| Dispositivo | Whisper V3 | V3 Turbo | Aceleracion |

|---|---|---|---|

| iPhone 15 Pro | 425 s | 82 s | 5.2× |

| iPad Pro M2 | 380 s | 71 s | 5.4× |

| MacBook Pro M2 | 316 s | 63 s | 5.0× |

La aceleracion de 5× es especifica de Whisper Notes en Apple Silicon, donde el decoder mas pequeno se beneficia de la optimizacion del Neural Engine. En GPU con frameworks como faster-whisper, la diferencia se reduce a ~2.7× (ver benchmarks de la comunidad abajo).

Precision: comparacion de WER

El Hugging Face Open ASR Leaderboard prueba ambos modelos en los mismos datasets en ingles. La tasa de error por palabra (WER) de Turbo esta dentro de medio punto de V3 en cada benchmark:

| Dataset | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| WER promedio | 7.83% | 7.44% |

V3 es ligeramente mas preciso en cada dataset, pero la diferencia es pequena — 0.39 puntos porcentuales en promedio. Para la mayoria de transcripciones reales, no vas a notar la diferencia.

En la evaluacion de formato largo YouTube-commons (uno de los benchmarks ASR de codigo abierto mas grandes), Turbo obtiene 13.40% WER vs 13.20% de V3 — mientras funciona a un factor de tiempo real de 129.5× vs 55.3×. Eso es 2.3× mas rapido con precision casi identica en audio del mundo real.

Benchmarks de la comunidad: GPU y CPU

Benchmarks independientes de las comunidades de faster-whisper y whisper.cpp muestran resultados consistentes en distintos hardware. Transcribiendo 13 minutos de audio con faster-whisper en GPU:

| Modelo | Precision | Tiempo | Memoria GPU | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 s | 2,537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 s | 4,521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 s | 1,545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 s | 2,409 MB | 2.39% |

Fuente: benchmark de faster-whisper en GPU NVIDIA, split de validacion limpio de LibriSpeech. Turbo int8 usa solo 1.5 GB de VRAM — cabe en una GPU de 2 GB.

La inferencia por lotes en una RTX 3060 Laptop (6 GB VRAM, precision int8) amplifica aun mas la ventaja:

| Modelo | Secuencial | Por lotes (10) | WER por lotes |

|---|---|---|---|

| Large-v3 Turbo | 46.1 s | 18.7 s | 7.7% |

| Large-v3 | 230.8 s | 43.0 s | 7.9% |

| Large-v2 | 178.3 s | 43.2 s | 8.8% |

| Medium | 113.3 s | 26.3 s | 8.9% |

Fuente: benchmark de NilaierMusic, Intel i7-12650H + RTX 3060 Laptop 6 GB, audio en frances, precision int8.

Con procesamiento por lotes, Turbo logra el mejor WER de todos los modelos probados (7.7%) siendo al mismo tiempo el mas rapido. Es el punto optimo indiscutible para uso en produccion.

Limitaciones conocidas (y como Whisper Notes las maneja)

Sin traduccion integrada

Turbo fue entrenado sin datos de traduccion. Solo transcribe en el idioma original — a diferencia de Large-v3, que soporta traduccion audio-a-ingles.

Whisper Notes — Apple Intelligence traduce automaticamente las transcripciones a tu idioma elegido, dandote salida bilingue sin importar que modelo uses.

Mas alucinaciones en audio ruidoso

Reportes de la comunidad indican que Turbo alucina mas en clips muy cortos o grabaciones ruidosas comparado con V3. Esperable dado el decoder reducido (4 capas vs 32).

Whisper Notes — ejecuta Pyannote VAD antes de la transcripcion, detectando segmentos de voz y eliminando silencio/ruido para que el modelo solo procese voz real.

Que modelo deberias usar?

| Ingles / Europeos | Parakeet V3 — 10× mas rapido que Whisper, mejor precision |

| Chino / Japones / Coreano | SenseVoice — disenado para CJK, velocidad 52× |

| Otros idiomas | Whisper Large V3 Turbo — 99 idiomas, alta precision, mas lento |