Whisper Large-v3 Turbo ของ OpenAI ลดดีโค้ดเดอร์จาก 32 เลเยอร์เหลือ 4 ลดพารามิเตอร์จาก 1.55B เหลือ 809M ผลลัพธ์คือ: การถอดเสียงเร็วขึ้น 2-5 เท่า ด้วยความแม่นยำเกือบเท่ากัน Whisper Notes นำเสนอบน Mac ที่มี Apple Silicon

V3 Turbo เทียบกับ V3: อะไรเปลี่ยนแปลง

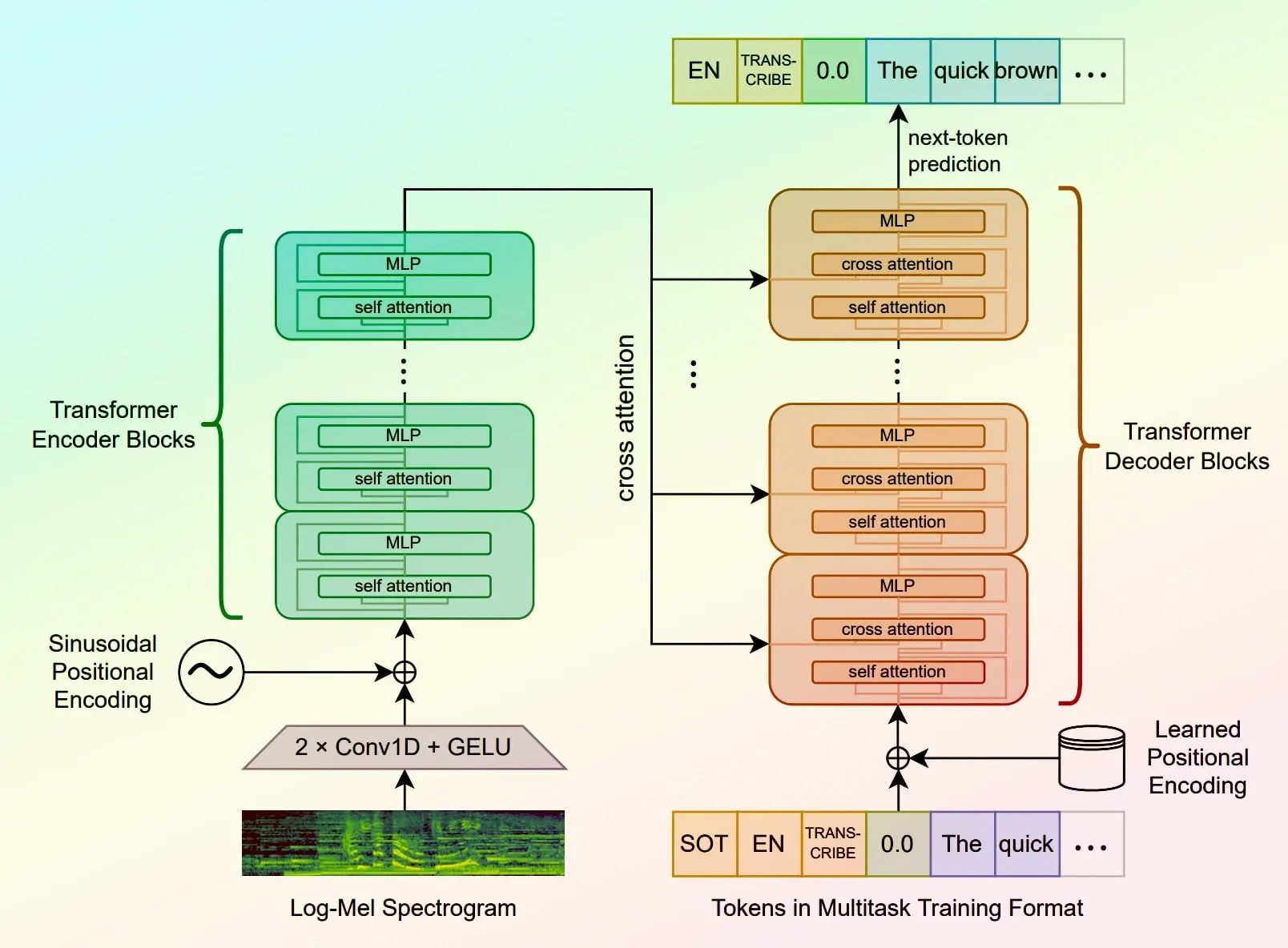

Turbo ไม่ใช่สถาปัตยกรรมใหม่ เป็นโมเดล Whisper Large-v3 ตัวเดียวกันทุกประการ โดยดีโค้ดเดอร์ถูกตัดจาก 32 เลเยอร์เหลือ 4 แล้วปรับแต่งละเอียดเพื่อกู้คืนความแม่นยำ เอ็นโค้ดเดอร์ไม่ถูกแตะต้อง

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| พารามิเตอร์ | 809M | 1,550M |

| เลเยอร์ดีโค้ดเดอร์ | 4 | 32 |

| ภาษา | 99 | 99 |

| งานแปลภาษา | ไม่รองรับ | รองรับ |

| สัญญาอนุญาต | MIT | Apache 2.0 |

งานแปลภาษาถูกตัดออกจากข้อมูลฝึกของ Turbo อย่างชัดเจน โมเดล Large-v3 แบบเต็มรองรับ แต่ Whisper Notes ส่งมอบ Turbo เท่านั้น - การแปลจัดการแยกต่างหากผ่าน Apple Intelligence

เบนช์มาร์กความเร็ว: Whisper Notes บน Apple Silicon

ใน Whisper Notes สำหรับ Mac Turbo ทำงานผ่าน CoreML บน Neural Engine การประมวลผลเสียง 10 นาที:

| อุปกรณ์ | Whisper V3 | V3 Turbo | ความเร็วที่เพิ่มขึ้น |

|---|---|---|---|

| iPhone 15 Pro | 425 s | 82 s | 5.2× |

| iPad Pro M2 | 380 s | 71 s | 5.4× |

| MacBook Pro M2 | 316 s | 63 s | 5.0× |

ความเร็วที่เพิ่มขึ้น 5 เท่าเฉพาะสำหรับ Whisper Notes บน Apple Silicon ซึ่งดีโค้ดเดอร์ขนาดเล็กได้ประโยชน์จากการเพิ่มประสิทธิภาพของ Neural Engine บน GPU ด้วยเฟรมเวิร์กอย่าง faster-whisper ช่องว่างจะลดลงเหลือ ~2.7 เท่า (ดูเบนช์มาร์กของชุมชนด้านล่าง)

ความแม่นยำ: การเปรียบเทียบ WER

Hugging Face Open ASR Leaderboard ทดสอบทั้งสองโมเดลบนชุดข้อมูลภาษาอังกฤษเดียวกัน อัตราข้อผิดพลาดของคำ (WER) ของ Turbo อยู่ภายในครึ่งจุดเปอร์เซ็นต์ของ V3 ในทุกเบนช์มาร์ก:

| ชุดข้อมูล | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| WER เฉลี่ย | 7.83% | 7.44% |

V3 แม่นยำกว่าเล็กน้อยในทุกชุดข้อมูล แต่ช่องว่างน้อยมาก - เฉลี่ย 0.39 จุดเปอร์เซ็นต์ สำหรับการถอดเสียงในโลกจริงส่วนใหญ่ คุณจะไม่ได้ยินความแตกต่าง

ในการประเมิน YouTube-commons สำหรับเสียงยาว (หนึ่งในเบนช์มาร์ก ASR โอเพนซอร์สที่ใหญ่ที่สุด) Turbo ได้คะแนน 13.40% WER เทียบกับ 13.20% ของ V3 - ด้วยอัตราส่วนเรียลไทม์ 129.5 เท่า เทียบกับ 55.3 เท่า นั่นคือเร็วกว่า 2.3 เท่าด้วยความแม่นยำเกือบเท่ากันบนเสียงจริง

เบนช์มาร์กชุมชน: GPU และ CPU

เบนช์มาร์กอิสระจากชุมชน faster-whisper และ whisper.cpp แสดงผลลัพธ์ที่สอดคล้องกันข้ามฮาร์ดแวร์ การถอดเสียง 13 นาทีด้วย faster-whisper บน GPU:

| โมเดล | ความละเอียด | เวลา | หน่วยความจำ GPU | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 s | 2,537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 s | 4,521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 s | 1,545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 s | 2,409 MB | 2.39% |

แหล่งที่มา: เบนช์มาร์ก faster-whisper บน NVIDIA GPU, LibriSpeech clean validation split Turbo int8 ใช้เพียง 1.5 GB VRAM - พอดีกับ GPU 2 GB

การอนุมานแบบแบตช์บน RTX 3060 Laptop (6 GB VRAM, ความละเอียด int8) ผลักดันข้อได้เปรียบต่อไปอีก:

| โมเดล | ลำดับ | แบตช์ (10) | WER แบตช์ |

|---|---|---|---|

| Large-v3 Turbo | 46.1 s | 18.7 s | 7.7% |

| Large-v3 | 230.8 s | 43.0 s | 7.9% |

| Large-v2 | 178.3 s | 43.2 s | 8.8% |

| Medium | 113.3 s | 26.3 s | 8.9% |

แหล่งที่มา: เบนช์มาร์ก NilaierMusic, Intel i7-12650H + RTX 3060 Laptop 6 GB, เสียงภาษาฝรั่งเศส, ความละเอียด int8

ด้วยการประมวลผลแบบแบตช์ Turbo ทำได้ WER ดีที่สุดจากทุกโมเดลที่ทดสอบ (7.7%) ขณะเดียวกันก็เร็วที่สุด เป็นจุดที่เหมาะสมที่สุดอย่างชัดเจนสำหรับการใช้งานจริง

ข้อจำกัดที่ทราบ (และ Whisper Notes จัดการอย่างไร)

ไม่มีการแปลในตัว

Turbo ถูกฝึกโดยไม่มีข้อมูลการแปล จะถอดเสียงเป็นภาษาต้นทางเท่านั้น - ต่างจาก Large-v3 ที่รองรับการแปลเสียงเป็นภาษาอังกฤษ

Whisper Notes - Apple Intelligence แปลบทถอดเสียงเป็นภาษาที่คุณเลือกโดยอัตโนมัติ ให้ผลลัพธ์สองภาษาไม่ว่าจะใช้โมเดลใด

ภาพหลอนมากขึ้นในเสียงที่มีสัญญาณรบกวน

รายงานจากชุมชนระบุว่า Turbo เกิดภาพหลอนมากกว่าในคลิปสั้นมากหรือการบันทึกที่มีเสียงรบกวนเมื่อเทียบกับ V3 ซึ่งเป็นไปตามคาดเนื่องจากดีโค้ดเดอร์ที่ลดลง (4 เลเยอร์ เทียบกับ 32)

Whisper Notes - เรียกใช้ Pyannote VAD ก่อนการถอดเสียง ตรวจจับส่วนที่มีเสียงพูดและตัดความเงียบ/เสียงรบกวนออก เพื่อให้โมเดลประมวลผลเฉพาะเสียงพูดจริง

คุณควรใช้โมเดลไหน?

| อังกฤษ / ยุโรป | Parakeet V3 - เร็วกว่า Whisper 10 เท่า ความแม่นยำดีกว่า |

| จีน / ญี่ปุ่น / เกาหลี | SenseVoice - สร้างมาเฉพาะสำหรับ CJK ความเร็ว 52 เท่า |

| ภาษาอื่นๆ | Whisper Large V3 Turbo - 99 ภาษา ความแม่นยำสูง ช้ากว่า |