Il Whisper Large-v3 Turbo di OpenAI riduce il decoder da 32 a 4 livelli, portando i parametri da 1,55 miliardi a 809 milioni. Il risultato: trascrizione 2-5 volte piu veloce con precisione quasi identica. Whisper Notes lo integra su Mac con Apple Silicon.

V3 Turbo vs V3: cosa e cambiato

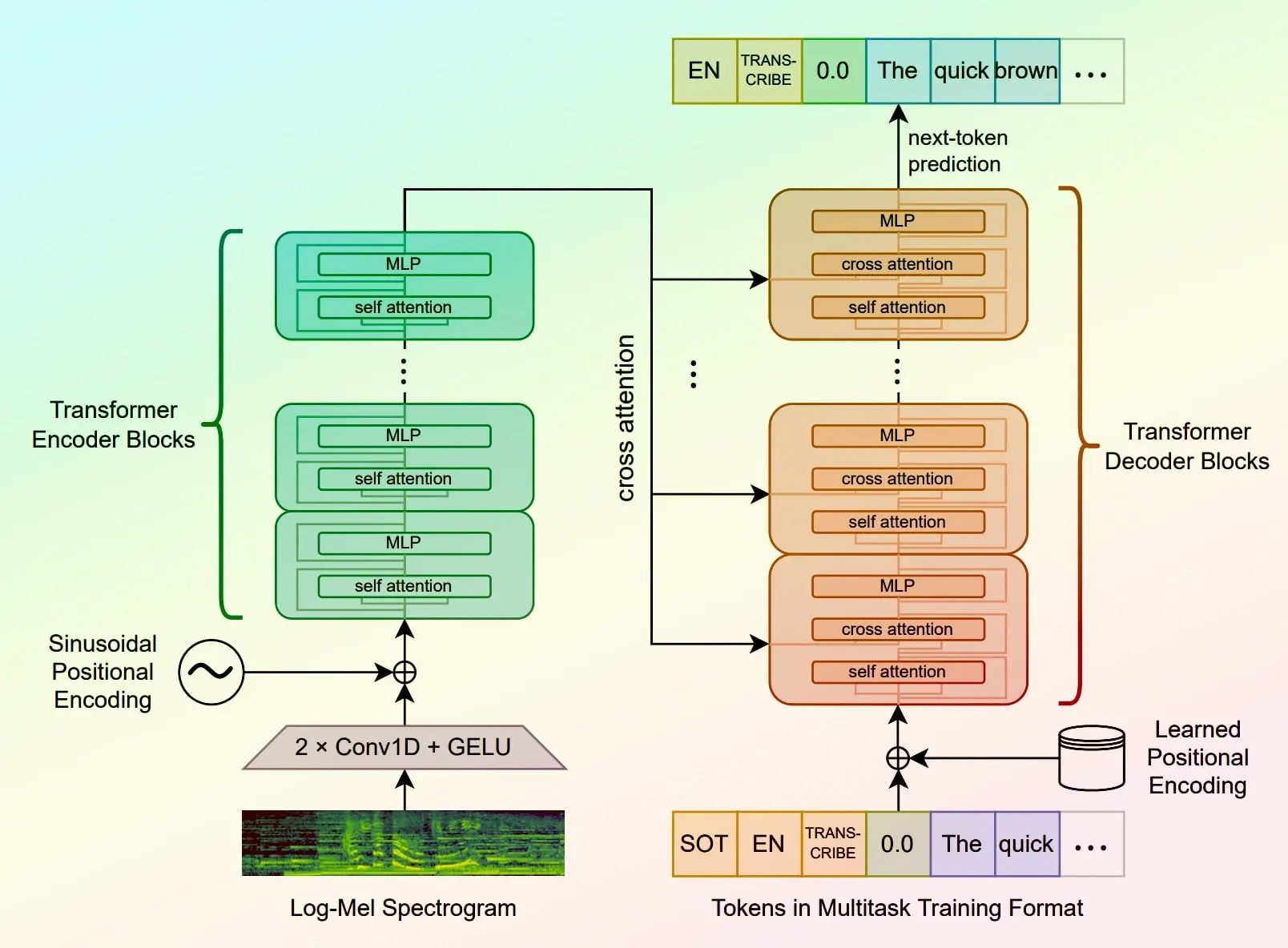

Turbo non e una nuova architettura. E lo stesso identico modello Whisper Large-v3 con il decoder potato da 32 a 4 livelli, poi riallenato per recuperare la precisione. L'encoder non e stato modificato.

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| Parametri | 809M | 1,550M |

| Livelli decoder | 4 | 32 |

| Lingue | 99 | 99 |

| Traduzione | Non supportata | Supportata |

| Licenza | MIT | Apache 2.0 |

La traduzione e stata esplicitamente esclusa dai dati di addestramento di Turbo. Il modello completo Large-v3 la supporta, ma Whisper Notes integra solo Turbo -- la traduzione viene gestita separatamente tramite Apple Intelligence.

Benchmark velocita: Whisper Notes su Apple Silicon

In Whisper Notes per Mac, Turbo funziona tramite CoreML sulla Neural Engine. Elaborazione di 10 minuti di audio:

| Dispositivo | Whisper V3 | V3 Turbo | Accelerazione |

|---|---|---|---|

| iPhone 15 Pro | 425 s | 82 s | 5.2× |

| iPad Pro M2 | 380 s | 71 s | 5.4× |

| MacBook Pro M2 | 316 s | 63 s | 5.0× |

L'accelerazione di 5 volte e specifica per Whisper Notes su Apple Silicon, dove il decoder piu piccolo beneficia dell'ottimizzazione della Neural Engine. Su GPU con framework come faster-whisper, il divario si riduce a circa 2,7 volte (vedi benchmark della community qui sotto).

Precisione: confronto WER

La classifica Hugging Face Open ASR testa entrambi i modelli sugli stessi dataset in inglese. Il tasso di errore per parola di Turbo e entro mezzo punto percentuale rispetto a V3 in ogni benchmark:

| Dataset | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| WER medio | 7.83% | 7.44% |

V3 e leggermente piu preciso su ogni dataset, ma la differenza e piccola -- 0,39 punti percentuali in media. Nella maggior parte delle trascrizioni reali, non si nota la differenza.

Nella valutazione YouTube-commons a lungo formato (uno dei piu grandi benchmark ASR open-source), Turbo ottiene il 13,40% di WER contro il 13,20% di V3 -- con un fattore real-time di 129,5× contro 55,3×. 2,3 volte piu veloce con precisione quasi identica su audio reale.

Benchmark della community: GPU & CPU

Benchmark indipendenti dalle community faster-whisper e whisper.cpp mostrano risultati coerenti su diversi hardware. Trascrizione di 13 minuti di audio con faster-whisper su GPU:

| Modello | Precisione | Tempo | Memoria GPU | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 s | 2,537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 s | 4,521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 s | 1,545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 s | 2,409 MB | 2.39% |

Fonte: benchmark faster-whisper su GPU NVIDIA, split di validazione LibriSpeech clean. Turbo int8 usa solo 1,5 GB di VRAM -- funziona anche su GPU da 2 GB.

L'inferenza in batch su un RTX 3060 Laptop (6 GB VRAM, precisione int8) amplifica ulteriormente il vantaggio:

| Modello | Sequenziale | Batch (10) | WER batch |

|---|---|---|---|

| Large-v3 Turbo | 46.1 s | 18.7 s | 7.7% |

| Large-v3 | 230.8 s | 43.0 s | 7.9% |

| Large-v2 | 178.3 s | 43.2 s | 8.8% |

| Medium | 113.3 s | 26.3 s | 8.9% |

Fonte: benchmark NilaierMusic, Intel i7-12650H + RTX 3060 Laptop 6 GB, audio in francese, precisione int8.

Con l'elaborazione in batch, Turbo ottiene il miglior WER tra tutti i modelli testati (7,7%) ed e anche il piu veloce. La scelta ottimale per l'uso in produzione.

Limitazioni note (e come Whisper Notes le gestisce)

Nessuna traduzione integrata

Turbo e stato addestrato senza dati di traduzione. Trascrive solo nella lingua originale -- a differenza di Large-v3, che supporta la traduzione audio verso inglese.

Whisper Notes -- Apple Intelligence traduce automaticamente le trascrizioni nella lingua scelta, fornendo output bilingue indipendentemente dal modello utilizzato.

Piu allucinazioni con audio rumoroso

I report della community indicano che Turbo ha piu allucinazioni su clip molto brevi o registrazioni rumorose rispetto a V3. Prevedibile dato il decoder ridotto (4 livelli vs 32).

Whisper Notes -- esegue Pyannote VAD prima della trascrizione, rileva i segmenti vocali e rimuove silenzio e rumore in modo che il modello elabori solo la voce reale.

Quale modello dovresti usare?

| Inglese / Europeo | Parakeet V3 -- 10 volte piu veloce di Whisper, precisione migliore |

| Cinese / Giapponese / Coreano | SenseVoice -- progettato per CJK, 52 volte piu veloce |

| Altre lingue | Whisper Large V3 Turbo -- 99 lingue, alta precisione, piu lento |