雲端轉錄已死。只是它自己還不知道。

你的手機有神經引擎。用它。

延遲問題

雲端轉錄的流程:你說話,音訊上傳到伺服器,API 處理,結果返回。即使是「即時」服務,10 秒的錄音也需要 2-3 秒的網路往返。

本地轉錄:這些延遲全部消失。音訊不離開你的裝置,處理在晶片上完成,結果即刻呈現。沒有上傳,沒有等待,沒有「處理中」的轉圈。

與此同時,你的 iPhone 有一個每秒 15 兆次運算的神經引擎。它閒著,而你的聲音在太平洋上空來回跳躍。

這在物理上是荒謬的。

2019 年,雲端轉錄是有道理的。你的手機跑不動十億參數的神經網路。這個限制已經不存在了。iPhone 15 Pro 運行 Whisper 模型比大多數雲端服務返回結果還快。M3 MacBook 處理 60 分鐘音訊只需 5 分鐘——本地、離線、無需上傳。

雲端轉錄靠的是慣性,不是技術必要性。

你已經為晶片付過錢了

有件事應該讓你感到困擾。

蘋果的 M3 晶片要收溢價。你付過了。那個神經引擎?你擁有它。180 億個為機器學習優化的電晶體?是你的。

然後你每月付 10 美元給 Otter.ai,讓他們的伺服器來轉錄音訊。

你在租別人的硬體,而你自己的硬體更快。這就像買了跑車卻付錢搭計程車。

雲端轉錄的經濟學在本地推理不可能的時候是有道理的。現在它只是慣性稅。三年下來,每月 10 美元的訂閱要花 360 美元。Whisper Notes 只要 6.99 美元,一次性。同樣的準確率。更快的處理。你的晶片做它被設計來做的事。

| 服務 | 第1年 | 第3年 | 第5年 |

|---|---|---|---|

| 雲端訂閱($10/月) | $120 | $360 | $600 |

| Whisper Notes(一次性) | $6.99 | $6.99 | $6.99 |

我們不收訂閱費,因為我們不運行伺服器。你的音訊從不接觸我們的基礎設施。沒有什麼需要按月計費。

資料外洩是架構問題

關於隱私,我們直說。

當你用雲端轉錄服務時,你的音訊存在別人的伺服器上。那些伺服器有能存取的員工。那些伺服器連著網路。那些網路面臨攻擊。資料外洩不是意外——它們是把敏感資料儲存在第三方基礎設施上的架構必然結果。

語音資料有獨特的風險。不像密碼,你不能重設你的聲音。你的聲紋是永久的生物特徵識別。一旦外洩,就永遠被外洩了。攻擊者可以用聲紋繞過認證、身份詐騙或生成深度偽造。

消除這個風險的唯一方法是消除上傳。從不離開你裝置的音訊不可能成為伺服器端外洩的一部分。這不是功能——這是物理。

想想誰在錄製敏感音訊:

- 律師錄製客戶諮詢

- 心理諮商師記錄個案談話

- 記者保護消息來源

- 高階主管捕捉策略討論

- 醫師記錄病歷

對這些專業人士來說,雲端儲存不只是不方便——是責任隱患。本地轉錄不是偏好。是要求。

準確率:誠實的權衡

我們需要直說本地轉錄做得好什麼、不足在哪裡。

本地 Whisper 更擅長的:逐字轉錄。如果你需要精確記錄說了什麼——每個字、每個停頓、每個「嗯」——本地 Whisper 模型很出色。清晰音訊上 5-8% 的詞錯誤率與人工轉錄員相當。轉錄忠實於所說的話。

雲端 AI 更擅長的:總結和摘取。GPT-4o 可以聽一場會議,產出行動事項、摘要和後續任務。它理解字面意思之外的上下文。如果你想要「告訴我做了什麼決定」,雲端 AI 確實更好。

權衡是真實的。如果你的工作流是「轉錄 → 用 Claude/GPT 總結」,你可以兩全其美:準確的本地轉錄,智能的雲端總結。你的原始音訊保持私密。只有你選擇分享的文字離開你的裝置。

我們不假裝本地 AI 解決一切。我們相信為每項工作使用正確的工具。Whisper 是轉錄的正確工具。LLM 是理解的正確工具。組合它們——隱私重要的地方用本地,智慧重要的地方用雲端——是誠實的方法。

| 任務 | 最佳工具 | 原因 |

|---|---|---|

| 逐字轉錄 | 本地 Whisper | 隱私、速度、準確率 |

| 會議摘要 | 雲端 LLM(基於轉錄文字) | 上下文理解 |

| 行動事項提取 | 雲端 LLM(基於轉錄文字) | 語意推理 |

| 即時協作 | 雲端服務(Otter 等) | 多用戶協調 |

真實速度數據

在 M3 MacBook Pro 上,Whisper Large-v3 Turbo 處理音訊大約是即時速度的 12 倍。60 分鐘錄音大約 5 分鐘完成。

在 iPhone 15 Pro 上,優化模型運行大約是即時速度的 5 倍。同樣 60 分鐘錄音大約 12 分鐘。

與雲端服務對比:

| 錄音時長 | 雲端(典型) | M3 Mac(本地) | iPhone 15 Pro(本地) |

|---|---|---|---|

| 5 分鐘 | 45-90 秒 | ~25 秒 | ~60 秒 |

| 30 分鐘 | 3-6 分鐘 | ~2.5 分鐘 | ~6 分鐘 |

| 60 分鐘 | 6-12 分鐘 | ~5 分鐘 | ~12 分鐘 |

本地處理在大多數錄音長度上與雲端速度持平或更快。而且它在飛機上、地下室、保密設施裡都能工作——任何沒有網路的地方。

我們是怎麼做的

Whisper Notes 是這些原則的實現。幾個值得說明的具體決策:

鎖定畫面小工具

最好的想法總在不方便的時候出現。我們做了鎖定畫面小工具,一點就能開始錄音——不用打開 App,不用認證,不用檢查網路。本地處理意味著即時可用。

一點錄音。零網路依賴。

硬體自適應模型

Mac 有散熱空間和充足電力。iPhone 在口袋裡。我們為各自部署不同的模型配置:Mac 上是 Whisper Large-v3 Turbo(8.09 億參數),iPhone 上是優化的小模型。同樣的隱私保證,合適的資源使用。

你的資料,你的檔案

轉錄是你裝置上的檔案。標準格式,標準位置。沒有私有資料庫,沒有廠商鎖定。如果 Whisper Notes 明天消失,你的錄音仍然可以存取。批次匯出不是進階功能——它是你擁有的資料的自然狀態。

你的資料。你的格式。你的目的地。

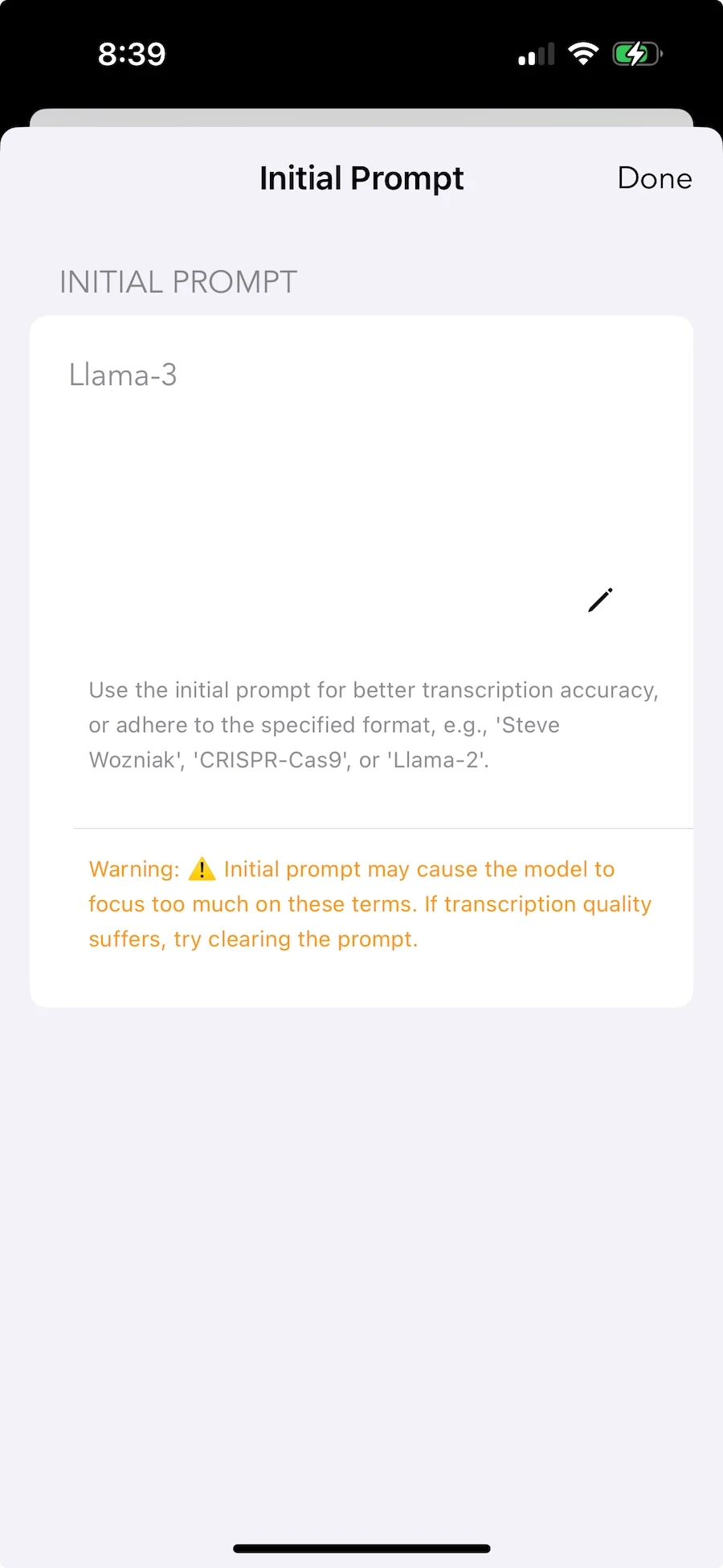

自訂詞彙

技術術語、不常見的名字、領域特定的詞——最需要準確轉錄的詞彙往往是你最不想上傳的。初始提示讓你在本地添加上下文。模型調整,而你的術語不會變成訓練資料。

本地個人化。你的詞彙保持私密。

什麼時候雲端更好

我們不假裝本地轉錄普遍更好。雲端有真正的優勢:

即時團隊協作。五個人在會議中同時編輯一份轉錄需要伺服器協調。本地工具天生是單用戶的。

大規模說話人辨識。多人錄音中的「誰說了什麼」受益於雲端規模的訓練資料。裝置端的說話人分離存在,但對大群組準確率較低。

工作流自動化。雲端服務連接 CRM,提取行動事項,發摘要到 Slack。本地工具產出文字檔案——你拿它們做什麼是手動的。

舊硬體。A14 之前的 iPhone、Intel Mac——有些裝置實際上無法運行本地推理。雲端仍是唯一選項。

誠實的評估:如果你的主要需求是會議期間的團隊協作,雲端工具可能更好。如果你的主要需求是帶隱私地轉錄自己的錄音,本地工具是正確的架構。

趨勢

每一代晶片都帶來更多神經引擎效能。每次模型迭代都帶來更好的效率。本地和雲端的差距在縮小,而隱私和延遲優勢保持不變。

雲端轉錄在你的手機做不了這個工作的時候是有道理的。那個時代在 2022 年左右結束了。剩下的是慣性——自動續費的訂閱,圍繞伺服器假設建立的工作流,雲端一定更好的模糊信念。

問題不是本地轉錄是否好用。它好用。問題是你是否想繼續為你已經擁有的硬體付租金。

技術細節

裝置要求:iPhone 12+(A14 晶片)或 M 系列晶片的 Mac。

模型:Parakeet V3(103 倍即時速度,英語 WER 6.32%)。SenseVoice Small(52 倍即時速度,支援中文、日語、韓語、粵語)。Whisper Large V3 Turbo(支援 100+ 種語言)。三個模型全部在 Mac 上本地運行。

速度:Parakeet V3:M4 Pro 上 35 分鐘音訊僅需 20 秒。SenseVoice:27 分鐘中文播客僅需 14 秒。Whisper Turbo:35 分鐘約需 3 分鐘。

AI 編輯:裝置端 Gemma 4 修正標點、移除填充詞(嗯、啊),生成標題,並回答關於轉錄內容的問題。

價格:$6.99 一次性。Mac 提供免費試用。不收訂閱費因為我們不運行伺服器。

常見問題

沒有網路能轉錄嗎?

可以。Whisper Notes 是完全離線的轉錄軟體,完全在你的裝置上運行。三個 AI 模型——Parakeet V3、SenseVoice 和 Whisper——使用你 Mac 的 Neural Engine 或 iPhone 的 A 系列晶片本地處理音訊。不上傳資料,不聯繫伺服器。你可以開啟飛航模式自己驗證。

OpenAI Whisper 能離線使用嗎?

可以。OpenAI 以開源模型的形式發布了 Whisper,這意味著它可以在你的硬體上本地運行。Whisper Notes 將 Whisper Large V3 Turbo 打包,透過 CoreML/Metal 在 Apple Silicon 上運行——無需 Python,無需命令列,無需聯網。支援 100+ 種語言離線語音辨識。

Whisper Notes 支援 Windows 或 Android 嗎?

暫不支援。Whisper Notes 目前支援 Mac(M 系列)和 iPhone(12+)。Windows 使用者可以選擇 faster-whisper(命令列)或 Buzz(GUI 介面)。未來可能支援其他平台,但 Apple Silicon 的 Neural Engine 目前為 Mac 使用者提供最佳的本地語音轉文字體驗。

有免費的離線轉錄應用嗎?

Whisper Notes 在 Mac 上提供免費試用——下載 DMG 即可試用,試用無時間限制。完整購買僅需 $6.99 一次性(無訂閱)。相比之下,Otter.ai 等雲端轉錄服務每月需 $10-20。三年下來就是 $360-720 對比 $6.99。

Whisper Notes 與 MacWhisper 或 faster-whisper 相比如何?

MacWhisper 是僅限 Mac 的 Whisper 前端。faster-whisper 是命令列工具。Whisper Notes 包含三個模型(Parakeet V3、SenseVoice、Whisper),支援 Mac 和 iPhone,提供系統級 Fn 鍵聽寫、鎖定畫面小工具、裝置端 AI 編輯和批次匯出——所有功能一次性 $6.99。