Le Whisper Large-v3 Turbo d'OpenAI reduit le decoder de 32 couches a 4, faisant passer les parametres de 1,55B a 809M. Le resultat : une transcription 2 a 5 fois plus rapide avec une precision quasi identique. Whisper Notes l'integre sur Mac avec Apple Silicon.

V3 Turbo vs V3 : ce qui a change

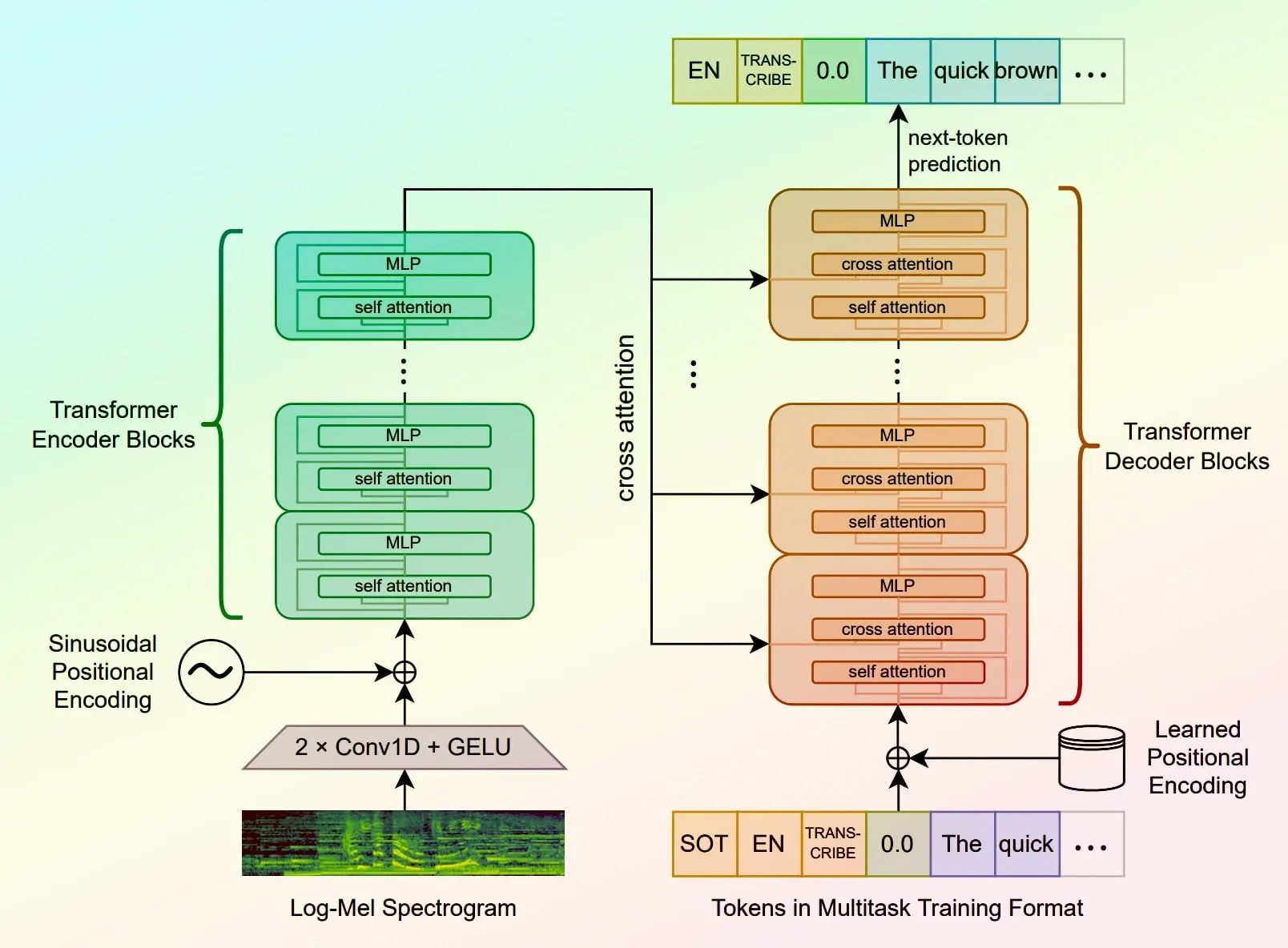

Turbo n'est pas une nouvelle architecture. C'est exactement le meme modele Whisper Large-v3 avec le decoder elague de 32 couches a 4, puis affine (fine-tuned) pour recuperer la precision. L'encoder reste inchange.

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| Parametres | 809M | 1,550M |

| Couches du decoder | 4 | 32 |

| Langues | 99 | 99 |

| Tache de traduction | Non supportee | Supportee |

| Licence | MIT | Apache 2.0 |

La tache de traduction a ete explicitement exclue des donnees d'entrainement de Turbo. Le modele complet Large-v3 la supporte, mais Whisper Notes n'integre que Turbo — la traduction est geree separement via Apple Intelligence.

Benchmark de vitesse : Whisper Notes sur Apple Silicon

Dans Whisper Notes pour Mac, Turbo fonctionne via CoreML sur le Neural Engine. Traitement de 10 minutes d'audio :

| Appareil | Whisper V3 | V3 Turbo | Acceleration |

|---|---|---|---|

| iPhone 15 Pro | 425 s | 82 s | 5,2× |

| iPad Pro M2 | 380 s | 71 s | 5,4× |

| MacBook Pro M2 | 316 s | 63 s | 5,0× |

L'acceleration de 5× est specifique a Whisper Notes sur Apple Silicon, ou le decoder plus petit beneficie de l'optimisation du Neural Engine. Sur GPU avec des frameworks comme faster-whisper, l'ecart se reduit a ~2,7× (voir les benchmarks communautaires ci-dessous).

Precision : comparaison du WER

Le Hugging Face Open ASR Leaderboard teste les deux modeles sur les memes datasets en anglais. Le taux d'erreur par mot (WER) de Turbo reste a moins d'un demi-point de V3 sur chaque benchmark :

| Dataset | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| WER moyen | 7.83% | 7.44% |

V3 est legerement plus precis sur chaque dataset, mais l'ecart est faible — 0,39 point de pourcentage en moyenne. Pour la plupart des transcriptions reelles, vous ne remarquerez pas la difference.

Sur l'evaluation longue duree YouTube-commons (l'un des plus grands benchmarks ASR open source), Turbo obtient 13,40% de WER contre 13,20% pour V3 — tout en fonctionnant a un facteur temps reel de 129,5× contre 55,3×. C'est 2,3× plus rapide avec une precision quasi identique sur de l'audio reel.

Benchmarks communautaires : GPU et CPU

Des benchmarks independants des communautes faster-whisper et whisper.cpp montrent des resultats coherents sur differents materiels. Transcription de 13 minutes d'audio avec faster-whisper sur GPU :

| Modele | Precision | Temps | Memoire GPU | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 s | 2,537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 s | 4,521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 s | 1,545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 s | 2,409 MB | 2.39% |

Source : benchmark faster-whisper sur GPU NVIDIA, split de validation propre de LibriSpeech. Turbo int8 n'utilise que 1,5 Go de VRAM — il tient dans un GPU de 2 Go.

L'inference par lots sur une RTX 3060 Laptop (6 Go VRAM, precision int8) amplifie encore l'avantage :

| Modele | Sequentiel | Par lots (10) | WER par lots |

|---|---|---|---|

| Large-v3 Turbo | 46.1 s | 18.7 s | 7.7% |

| Large-v3 | 230.8 s | 43.0 s | 7.9% |

| Large-v2 | 178.3 s | 43.2 s | 8.8% |

| Medium | 113.3 s | 26.3 s | 8.9% |

Source : benchmark NilaierMusic, Intel i7-12650H + RTX 3060 Laptop 6 Go, audio en francais, precision int8.

Avec le traitement par lots, Turbo obtient le meilleur WER de tous les modeles testes (7,7%) tout en etant le plus rapide. C'est le choix optimal incontestable pour une utilisation en production.

Limitations connues (et comment Whisper Notes les gere)

Pas de traduction integree

Turbo a ete entraine sans donnees de traduction. Il ne transcrit que dans la langue source — contrairement a Large-v3, qui supporte la traduction audio vers anglais.

Whisper Notes — Apple Intelligence traduit automatiquement les transcriptions dans la langue de votre choix, vous offrant une sortie bilingue quel que soit le modele utilise.

Plus d'hallucinations sur l'audio bruite

Les retours de la communaute indiquent que Turbo hallucine davantage sur les clips tres courts ou les enregistrements bruites par rapport a V3. Previsible vu le decoder reduit (4 couches vs 32).

Whisper Notes — execute Pyannote VAD avant la transcription, detectant les segments de parole et eliminant le silence/bruit pour que le modele ne traite que de la voix reelle.

Quel modele devriez-vous utiliser ?

| Anglais / Europeen | Parakeet V3 — 10× plus rapide que Whisper, meilleure precision |

| Chinois / Japonais / Coreen | SenseVoice — concu pour le CJK, vitesse 52× |

| Autres langues | Whisper Large V3 Turbo — 99 langues, haute precision, plus lent |