OpenAI-jev Whisper Large-v3 Turbo smanjuje dekoder s 32 sloja na 4, srezujuci parametre s 1,55B na 809M. Rezultat: 2-5× brza transkripcija s gotovo identicnom tocnoscu. Whisper Notes ga isporucuje na Mac s Apple Silicon.

V3 Turbo vs V3: Sto se promijenilo

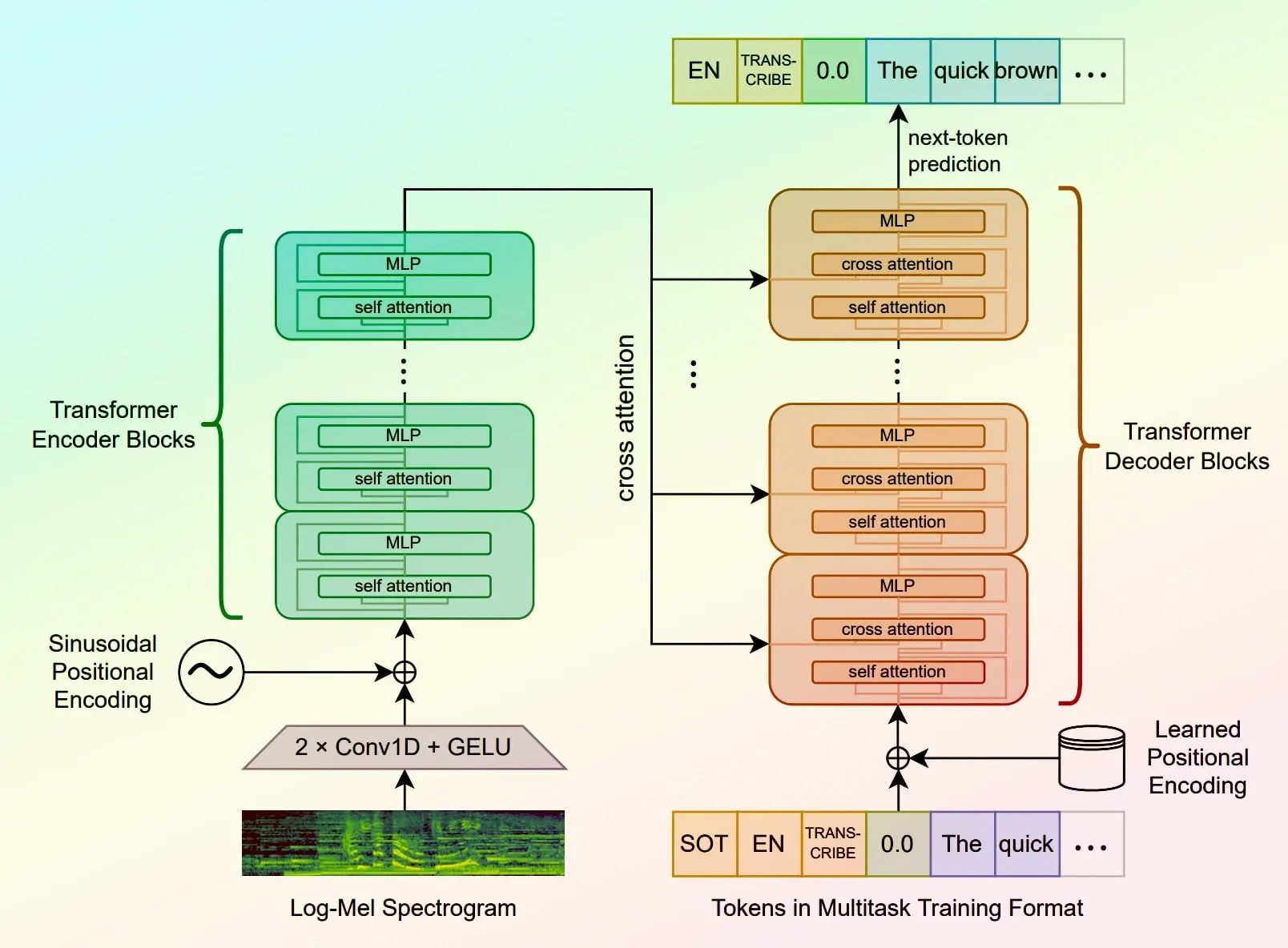

Turbo nije nova arhitektura. To je tocno isti model Whisper Large-v3 s dekoderom skracenim s 32 sloja na 4, zatim fino podesenim za oporavak tocnosti. Enkoder je netaknut.

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| Parametri | 809M | 1 550M |

| Slojevi dekodera | 4 | 32 |

| Jezici | 99 | 99 |

| Zadatak prijevoda | Nije podrzano | Podrzano |

| Licenca | MIT | Apache 2.0 |

Zadatak prijevoda je eksplicitno iskljucen iz podataka za treniranje Turba. Puni model Large-v3 ga podrzava, ali Whisper Notes isporucuje samo Turbo - prijevod se zasebno obavlja putem Apple Intelligence.

Benchmark brzine: Whisper Notes na Apple Silicon

U Whisper Notes za Mac, Turbo radi putem CoreML na Neural Engine. Obrada 10 minuta zvuka:

| Uredaj | Whisper V3 | V3 Turbo | Ubrzanje |

|---|---|---|---|

| iPhone 15 Pro | 425 s | 82 s | 5,2× |

| iPad Pro M2 | 380 s | 71 s | 5,4× |

| MacBook Pro M2 | 316 s | 63 s | 5,0× |

5× ubrzanje specificno je za Whisper Notes na Apple Silicon, gdje manji dekoder profitira od optimizacije Neural Engine. Na GPU s okvirima poput faster-whisper, razlika se smanjuje na ~2,7× (pogledajte komunitne benchmarkove u nastavku).

Tocnost: Usporedba WER

Hugging Face Open ASR Leaderboard testira oba modela na istim engleskim datasetovima. Stopa pogreske rijeci (WER) Turba je unutar pola postotnog boda od V3 u svim benchmarkovima:

| Dataset | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| Prosjecni WER | 7.83% | 7.44% |

V3 je neznatno tocniji na svakom datasetu, ali razlika je mala - prosjecno 0,39 postotnih bodova. Za vecinu stvarne transkripcije necete primijetiti razliku.

Na evaluaciji YouTube-commons za dugi format (jedan od najvecih open-source ASR benchmarkova), Turbo postize 13,40 % WER naspram 13,20 % V3-a - pri cemu radi s 129,5× real-time faktorom naspram 55,3×. To je 2,3× brze s gotovo identicnom tocnoscu na stvarnom zvuku.

Komunitni benchmarkovi: GPU i CPU

Nezavisni benchmarkovi iz zajednica faster-whisper i whisper.cpp pokazuju dosljedne rezultate na razlicitom hardveru. Transkripcija 13 minuta zvuka s faster-whisper na GPU:

| Model | Preciznost | Vrijeme | GPU memorija | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 s | 2 537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 s | 4 521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 s | 1 545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 s | 2 409 MB | 2.39% |

Izvor: benchmark faster-whisper na NVIDIA GPU, LibriSpeech clean validacijski split. Turbo int8 koristi samo 1,5 GB VRAM - stane na 2 GB GPU.

Skupna inferencija na RTX 3060 Laptop (6 GB VRAM, int8 preciznost) gura prednost jos dalje:

| Model | Sekvencijalno | Skupno (10) | Skupni WER |

|---|---|---|---|

| Large-v3 Turbo | 46.1 s | 18.7 s | 7.7% |

| Large-v3 | 230.8 s | 43.0 s | 7.9% |

| Large-v2 | 178.3 s | 43.2 s | 8.8% |

| Medium | 113.3 s | 26.3 s | 8.9% |

Izvor: benchmark NilaierMusic, Intel i7-12650H + RTX 3060 Laptop 6 GB, francuski zvuk, int8 preciznost.

Sa skupnom obradom, Turbo postize najbolji WER od svih testiranih modela (7,7 %) i pritom je najbrzi. To je jasna optimalna tocka za produkcijsku upotrebu.

Poznata ogranicenja (i kako ih Whisper Notes rjesava)

Nema ugradenog prijevoda

Turbo je trenirano bez podataka za prijevod. Transkribira samo na izvornom jeziku - za razliku od Large-v3 koji podrzava prijevod zvuka na engleski.

Whisper Notes - Apple Intelligence automatski prevodi transkripte na vas odabrani jezik, dajuci vam dvojezicni izlaz bez obzira na koristeni model.

Vise halucinacija na bucnom zvuku

Izvjesca zajednice ukazuju da Turbo vise halucinira na vrlo kratkim isjecima ili bucnim snimkama u usporedbi s V3. Ocekivano s obzirom na smanjeni dekoder (4 sloja naspram 32).

Whisper Notes - pokrece Pyannote VAD prije transkripcije, detektirajuci govorne segmente i uklanjajuci tisinu/buku tako da model obraduje samo stvarni glas.

Koji model biste trebali koristiti?

| Engleski / Europski | Parakeet V3 - 10× brzi od Whispera, bolja tocnost |

| Kineski / Japanski / Korejski | SenseVoice - namjenski izraden za CJK, 52× brzina |

| Ostali jezici | Whisper Large V3 Turbo - 99 jezika, visoka tocnost, sporiji |