Whisper Large-v3 Turbo от OpenAI сокращает декодер с 32 слоёв до 4, уменьшая число параметров с 1,55B до 809M. Результат: транскрипция в 2-5× быстрее при почти идентичной точности. Whisper Notes поставляет его на Mac с Apple Silicon.

V3 Turbo vs V3: Что изменилось

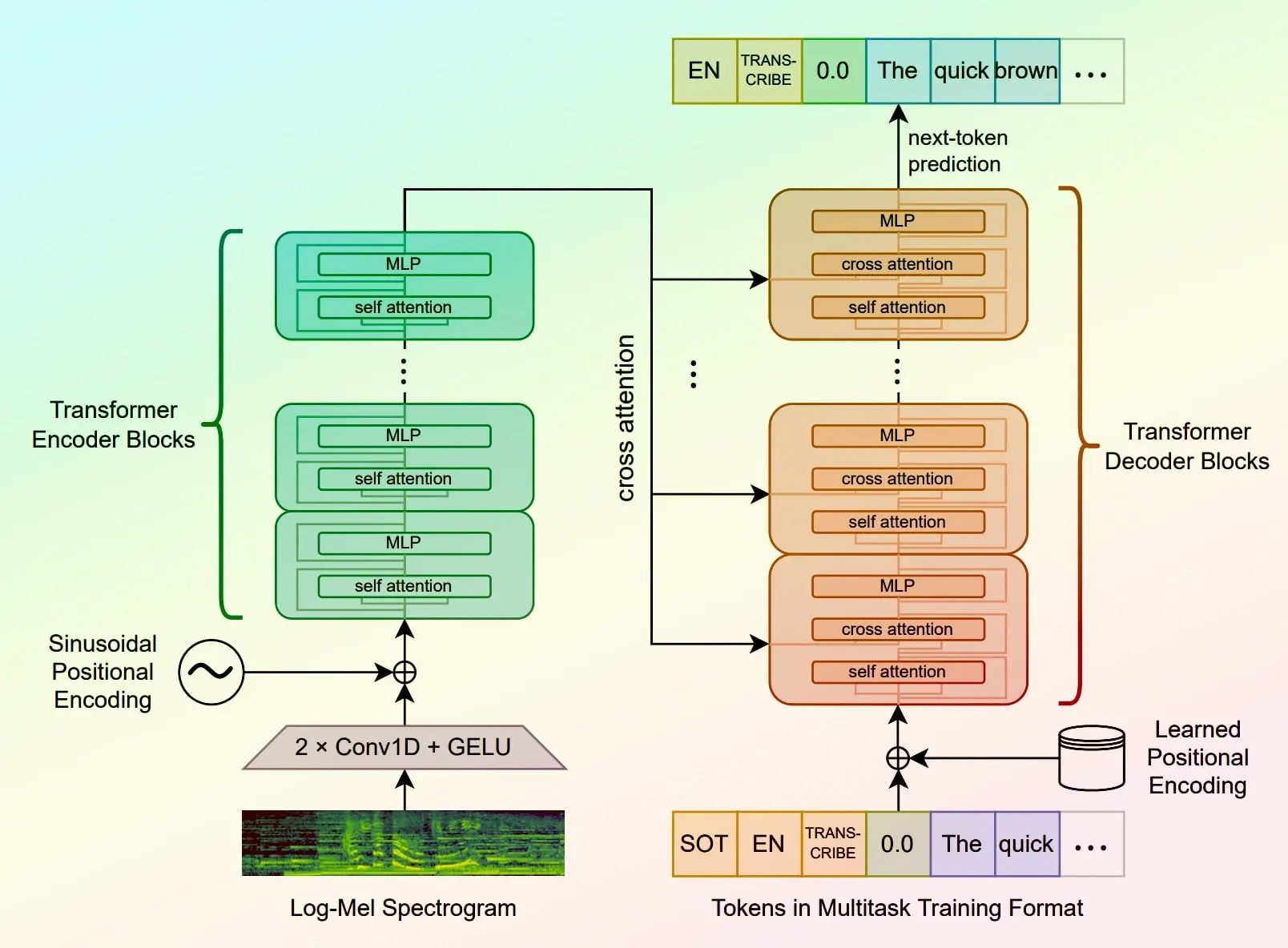

Turbo — это не новая архитектура. Это тот же самый Whisper Large-v3, у которого декодер урезан с 32 слоёв до 4, а затем дообучен для восстановления точности. Энкодер остался без изменений.

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| Параметры | 809M | 1,550M |

| Слои декодера | 4 | 32 |

| Языки | 99 | 99 |

| Задача перевода | Не поддерживается | Поддерживается |

| Лицензия | MIT | Apache 2.0 |

Задача перевода была явно исключена из обучающих данных Turbo. Полная модель Large-v3 её поддерживает, но Whisper Notes поставляет только Turbo — перевод обрабатывается отдельно через Apple Intelligence.

Бенчмарк скорости: Whisper Notes на Apple Silicon

В Whisper Notes для Mac Turbo работает через CoreML на Neural Engine. Обработка 10 минут аудио:

| Устройство | Whisper V3 | V3 Turbo | Ускорение |

|---|---|---|---|

| iPhone 15 Pro | 425 s | 82 s | 5.2× |

| iPad Pro M2 | 380 s | 71 s | 5.4× |

| MacBook Pro M2 | 316 s | 63 s | 5.0× |

Ускорение в 5× характерно именно для Whisper Notes на Apple Silicon, где уменьшенный декодер выигрывает от оптимизации Neural Engine. На GPU с фреймворками вроде faster-whisper разрыв сужается до ~2,7× (см. бенчмарки сообщества ниже).

Точность: Сравнение WER

Hugging Face Open ASR Leaderboard тестирует обе модели на одних и тех же англоязычных датасетах. WER (коэффициент ошибок слов) Turbo отличается от V3 менее чем на полпункта по каждому бенчмарку:

| Датасет | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| Средний WER | 7.83% | 7.44% |

V3 немного точнее на каждом датасете, но разница невелика — 0,39 процентных пункта в среднем. В большинстве реальных сценариев транскрипции вы не заметите разницы.

На оценке длинных записей YouTube-commons (одном из крупнейших открытых ASR-бенчмарков) Turbo показывает 13.40% WER против 13.20% у V3 — при этом работая со скоростью 129.5× от реального времени против 55.3×. Это в 2,3× быстрее при практически идентичной точности на реальном аудио.

Бенчмарки сообщества: GPU и CPU

Независимые бенчмарки от сообществ faster-whisper и whisper.cpp показывают стабильные результаты на разном оборудовании. Транскрипция 13 минут аудио с faster-whisper на GPU:

| Модель | Точность | Время | Память GPU | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 s | 2,537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 s | 4,521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 s | 1,545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 s | 2,409 MB | 2.39% |

Источник: бенчмарк faster-whisper на GPU NVIDIA, валидационный сплит LibriSpeech clean. Turbo int8 использует всего 1,5 ГБ VRAM — помещается в GPU с 2 ГБ.

Пакетная обработка на RTX 3060 Laptop (6 ГБ VRAM, точность int8) ещё больше увеличивает преимущество:

| Модель | Последовательно | Пакетно (10) | WER пакетно |

|---|---|---|---|

| Large-v3 Turbo | 46.1 s | 18.7 s | 7.7% |

| Large-v3 | 230.8 s | 43.0 s | 7.9% |

| Large-v2 | 178.3 s | 43.2 s | 8.8% |

| Medium | 113.3 s | 26.3 s | 8.9% |

Источник: бенчмарк NilaierMusic, Intel i7-12650H + RTX 3060 Laptop 6 ГБ, французское аудио, точность int8.

При пакетной обработке Turbo показывает лучший WER среди всех протестированных моделей (7,7%), одновременно являясь самым быстрым. Это оптимальный выбор для продакшена.

Известные ограничения (и как Whisper Notes их решает)

Нет встроенного перевода

Turbo обучался без данных для перевода. Он транскрибирует только на языке оригинала — в отличие от Large-v3, который поддерживает перевод аудио→английский.

Whisper Notes — Apple Intelligence автоматически переводит транскрипты на выбранный вами язык, обеспечивая двуязычный вывод независимо от используемой модели.

Больше галлюцинаций на шумном аудио

По отзывам сообщества, Turbo больше галлюцинирует на очень коротких клипах или шумных записях по сравнению с V3. Ожидаемо, учитывая урезанный декодер (4 слоя вместо 32).

Whisper Notes — запускает Pyannote VAD перед транскрипцией, определяя сегменты речи и удаляя тишину/шум, чтобы модель обрабатывала только реальную речь.

Какую модель выбрать?

| Английский / Европейские | Parakeet V3 — в 10× быстрее Whisper, выше точность |

| Китайский / Японский / Корейский | SenseVoice — создан для CJK, скорость 52× |

| Другие языки | Whisper Large V3 Turbo — 99 языков, высокая точность, медленнее |