云端转录已死。只是它自己还不知道。

你的手机有神经引擎。用它。

延迟问题

云端转录的流程:你说话,音频上传到服务器,API 处理,结果返回。即使是"实时"服务,10 秒的录音也需要 2-3 秒的网络往返。

本地转录:这些延迟全部消失。音频不离开你的设备,处理在芯片上完成,结果即刻呈现。没有上传,没有等待,没有"正在处理"的转圈。

与此同时,你的 iPhone 有一个每秒 15 万亿次运算的神经引擎。它闲着,而你的声音在太平洋上空来回跳跃。

这在物理上是荒谬的。

2019 年,云端转录是有道理的。你的手机跑不动十亿参数的神经网络。这个限制已经不存在了。iPhone 15 Pro 运行 Whisper 模型比大多数云服务返回结果还快。M3 MacBook 处理 60 分钟音频只需 5 分钟——本地、离线、无需上传。

云端转录靠的是惯性,不是技术必要性。

你已经为芯片付过钱了

有件事应该让你感到困扰。

苹果的 M3 芯片要收溢价。你付过了。那个神经引擎?你拥有它。180 亿个为机器学习优化的晶体管?是你的。

然后你每月付 10 美元给 Otter.ai,让他们的服务器来转录音频。

你在租别人的硬件,而你自己的硬件更快。这就像买了跑车却付钱打的。

云端转录的经济学在本地推理不可能的时候是有道理的。现在它只是惯性税。三年下来,每月 10 美元的订阅要花 360 美元。Whisper Notes 只要 6.99 美元,一次性。同样的准确率。更快的处理。你的芯片做它被设计来做的事。

| 服务 | 第1年 | 第3年 | 第5年 |

|---|---|---|---|

| 云端订阅($10/月) | $120 | $360 | $600 |

| Whisper Notes(一次性) | $6.99 | $6.99 | $6.99 |

我们不收订阅费,因为我们不运行服务器。你的音频从不接触我们的基础设施。没有什么需要按月计费。

数据泄露是架构问题

关于隐私,我们直说。

当你用云端转录服务时,你的音频存在别人的服务器上。那些服务器有能访问的员工。那些服务器连着网络。那些网络面临攻击。数据泄露不是意外——它们是把敏感数据存储在第三方基础设施上的架构必然结果。

语音数据有独特的风险。不像密码,你不能重置你的声音。你的声纹是永久的生物特征标识。一旦泄露,就永远被泄露了。攻击者可以用声纹绕过认证、身份欺诈或生成深度伪造。

消除这个风险的唯一方法是消除上传。从不离开你设备的音频不可能成为服务器端泄露的一部分。这不是功能——这是物理。

想想谁在录制敏感音频:

- 律师录制客户咨询

- 心理咨询师记录病人谈话

- 记者保护信息源

- 高管捕捉战略讨论

- 医生记录病历

对这些专业人士来说,云存储不只是不方便——是责任隐患。本地转录不是偏好。是要求。

准确率:诚实的权衡

我们需要直说本地转录做得好什么、不足在哪里。

本地 Whisper 更擅长的:逐字转录。如果你需要精确记录说了什么——每个字、每个停顿、每个"嗯"——本地 Whisper 模型很出色。清晰音频上 5-8% 的词错误率与人工转录员相当。转录忠实于所说的话。

云端 AI 更擅长的:总结和提取。GPT-4o 可以听一场会议,产出行动事项、摘要和后续任务。它理解字面意思之外的上下文。如果你想要"告诉我做了什么决定",云端 AI 确实更好。

权衡是真实的。如果你的工作流是"转录 → 用 Claude/GPT 总结",你可以两全其美:准确的本地转录,智能的云端总结。你的原始音频保持私密。只有你选择分享的文字离开你的设备。

我们不假装本地 AI 解决一切。我们相信为每项工作使用正确的工具。Whisper 是转录的正确工具。LLM 是理解的正确工具。组合它们——隐私重要的地方用本地,智能重要的地方用云端——是诚实的方法。

| 任务 | 最佳工具 | 原因 |

|---|---|---|

| 逐字转录 | 本地 Whisper | 隐私、速度、准确率 |

| 会议摘要 | 云端 LLM(基于转录文本) | 上下文理解 |

| 行动事项提取 | 云端 LLM(基于转录文本) | 语义推理 |

| 实时协作 | 云服务(Otter 等) | 多用户协调 |

真实速度数据

在 M3 MacBook Pro 上,Whisper Large-v3 Turbo 处理音频大约是实时速度的 12 倍。60 分钟录音大约 5 分钟完成。

在 iPhone 15 Pro 上,优化模型运行大约是实时速度的 5 倍。同样 60 分钟录音大约 12 分钟。

与云服务对比:

| 录音时长 | 云端(典型) | M3 Mac(本地) | iPhone 15 Pro(本地) |

|---|---|---|---|

| 5 分钟 | 45-90 秒 | ~25 秒 | ~60 秒 |

| 30 分钟 | 3-6 分钟 | ~2.5 分钟 | ~6 分钟 |

| 60 分钟 | 6-12 分钟 | ~5 分钟 | ~12 分钟 |

本地处理在大多数录音长度上与云端速度持平或更快。而且它在飞机上、地下室、保密设施里都能工作——任何没有网络的地方。

我们是怎么做的

Whisper Notes 是这些原则的实现。几个值得说明的具体决策:

锁屏小组件

最好的想法总在不方便的时候出现。我们做了锁屏小组件,一点就能开始录音——不用打开 App,不用认证,不用检查网络。本地处理意味着即时可用。

一点录音。零网络依赖。

硬件自适应模型

Mac 有散热空间和充足电力。iPhone 在口袋里。我们为各自部署不同的模型配置:Mac 上是 Whisper Large-v3 Turbo(8.09 亿参数),iPhone 上是优化的小模型。同样的隐私保证,合适的资源使用。

你的数据,你的文件

转录是你设备上的文件。标准格式,标准位置。没有私有数据库,没有厂商锁定。如果 Whisper Notes 明天消失,你的录音仍然可以访问。批量导出不是高级功能——它是你拥有的数据的自然状态。

你的数据。你的格式。你的目的地。

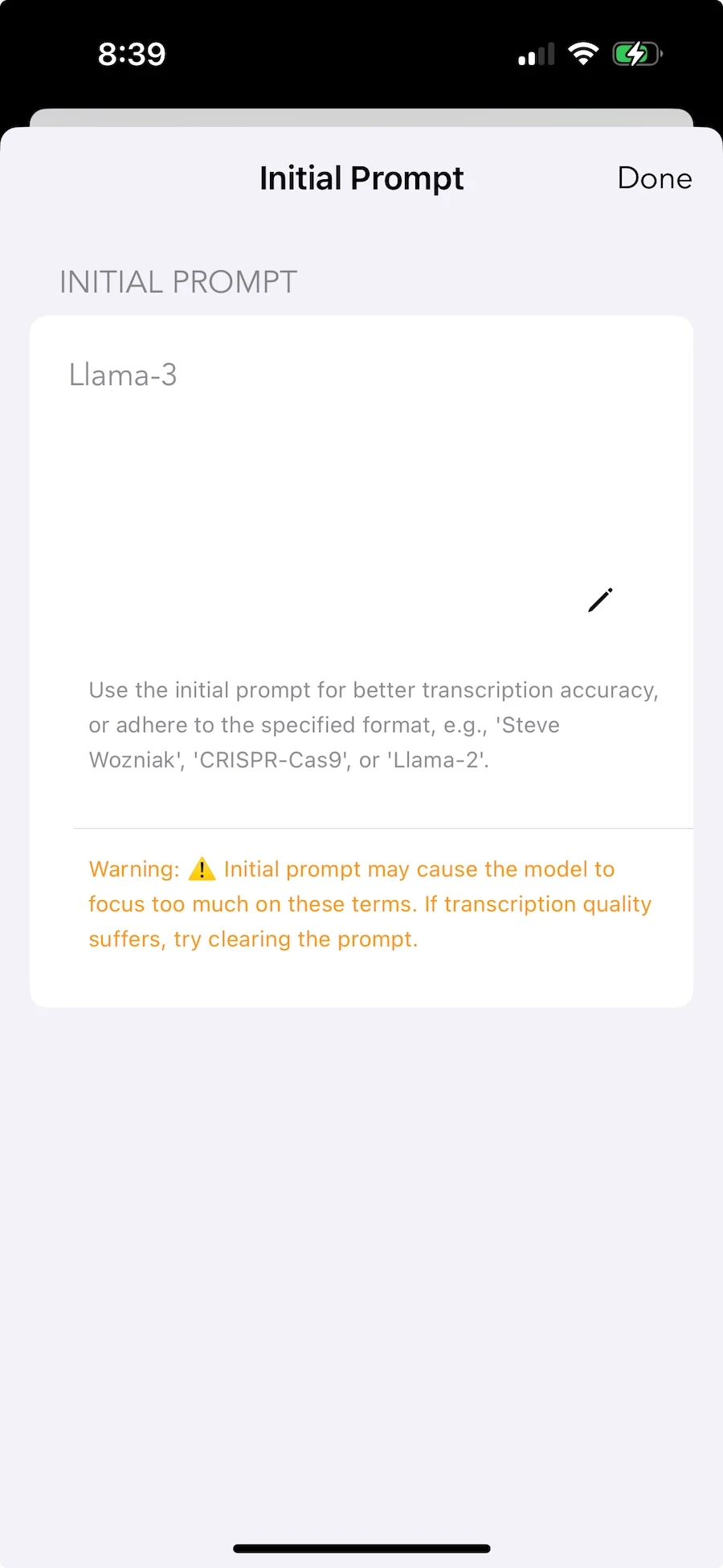

自定义词汇

技术术语、不常见的名字、领域特定的词——最需要准确转录的词汇往往是你最不想上传的。初始提示让你在本地添加上下文。模型调整,而你的术语不会变成训练数据。

本地个性化。你的词汇保持私密。

什么时候云端更好

我们不假装本地转录普遍更好。云端有真正的优势:

实时团队协作。五个人在会议中同时编辑一份转录需要服务器协调。本地工具天生是单用户的。

大规模说话人识别。多人录音中的"谁说了什么"受益于云规模的训练数据。设备端的说话人分离存在,但对大群组准确率较低。

工作流自动化。云服务连接 CRM,提取行动事项,发摘要到 Slack。本地工具产出文本文件——你拿它们做什么是手动的。

旧硬件。A14 之前的 iPhone、Intel Mac——有些设备实际上无法运行本地推理。云端仍是唯一选项。

诚实的评估:如果你的主要需求是会议期间的团队协作,云工具可能更好。如果你的主要需求是带隐私地转录自己的录音,本地工具是正确的架构。

趋势

每一代芯片都带来更多神经引擎性能。每次模型迭代都带来更好的效率。本地和云端的差距在缩小,而隐私和延迟优势保持不变。

云端转录在你的手机做不了这个工作的时候是有道理的。那个时代在 2022 年左右结束了。剩下的是惯性——自动续费的订阅,围绕服务器假设建立的工作流,云端一定更好的模糊信念。

问题不是本地转录是否好用。它好用。问题是你是否想继续为你已经拥有的硬件付租金。

技术细节

设备要求:iPhone 12+(A14 芯片)或 M 系列芯片的 Mac。

模型:Parakeet V3(103 倍实时速度,英语 WER 6.32%)。SenseVoice Small(52 倍实时速度,支持中文、日语、韩语、粤语)。Whisper Large V3 Turbo(支持 100+ 种语言)。三个模型全部在 Mac 上本地运行。

速度:Parakeet V3:M4 Pro 上 35 分钟音频仅需 20 秒。SenseVoice:27 分钟中文播客仅需 14 秒。Whisper Turbo:35 分钟约需 3 分钟。

AI 编辑:设备端 Gemma 4 修正标点、去除填充词(嗯、啊),生成标题,并回答关于转录内容的问题。

价格:$6.99 一次性。Mac 提供免费试用。不收订阅费因为我们不运行服务器。

常见问题

没有网络能转录吗?

可以。Whisper Notes 是完全离线的转录软件,完全在你的设备上运行。三个 AI 模型——Parakeet V3、SenseVoice 和 Whisper——使用你 Mac 的 Neural Engine 或 iPhone 的 A 系列芯片本地处理音频。不上传数据,不联系服务器。你可以开启飞行模式自己验证。

OpenAI Whisper 能离线使用吗?

可以。OpenAI 以开源模型的形式发布了 Whisper,这意味着它可以在你的硬件上本地运行。Whisper Notes 将 Whisper Large V3 Turbo 打包,通过 CoreML/Metal 在 Apple Silicon 上运行——无需 Python,无需命令行,无需联网。支持 100+ 种语言离线语音识别。

Whisper Notes 支持 Windows 或 Android 吗?

暂不支持。Whisper Notes 目前支持 Mac(M 系列)和 iPhone(12+)。Windows 用户可以选择 faster-whisper(命令行)或 Buzz(GUI 界面)。未来可能支持其他平台,但 Apple Silicon 的 Neural Engine 目前为 Mac 用户提供最佳的本地语音转文字体验。

有免费的离线转录应用吗?

Whisper Notes 在 Mac 上提供免费试用——下载 DMG 即可试用,试用无时间限制。完整购买仅需 $6.99 一次性(无订阅)。相比之下,Otter.ai 等云端转录服务每月需 $10-20。三年下来就是 $360-720 对比 $6.99。

Whisper Notes 与 MacWhisper 或 faster-whisper 相比如何?

MacWhisper 是仅限 Mac 的 Whisper 前端。faster-whisper 是命令行工具。Whisper Notes 包含三个模型(Parakeet V3、SenseVoice、Whisper),支持 Mac 和 iPhone,提供系统级 Fn 键听写、锁屏小组件、设备端 AI 编辑和批量导出——所有功能一次性 $6.99。