OpenAI 的 Whisper Large-v3 Turbo 将解码器从 32 层裁剪到 4 层,参数量从 15.5 亿降至 8.09 亿。结果:转录速度提升 2–5 倍,精度几乎不变。Whisper Notes 已在 Apple Silicon Mac 上搭载此模型。

V3 Turbo vs V3:改了什么

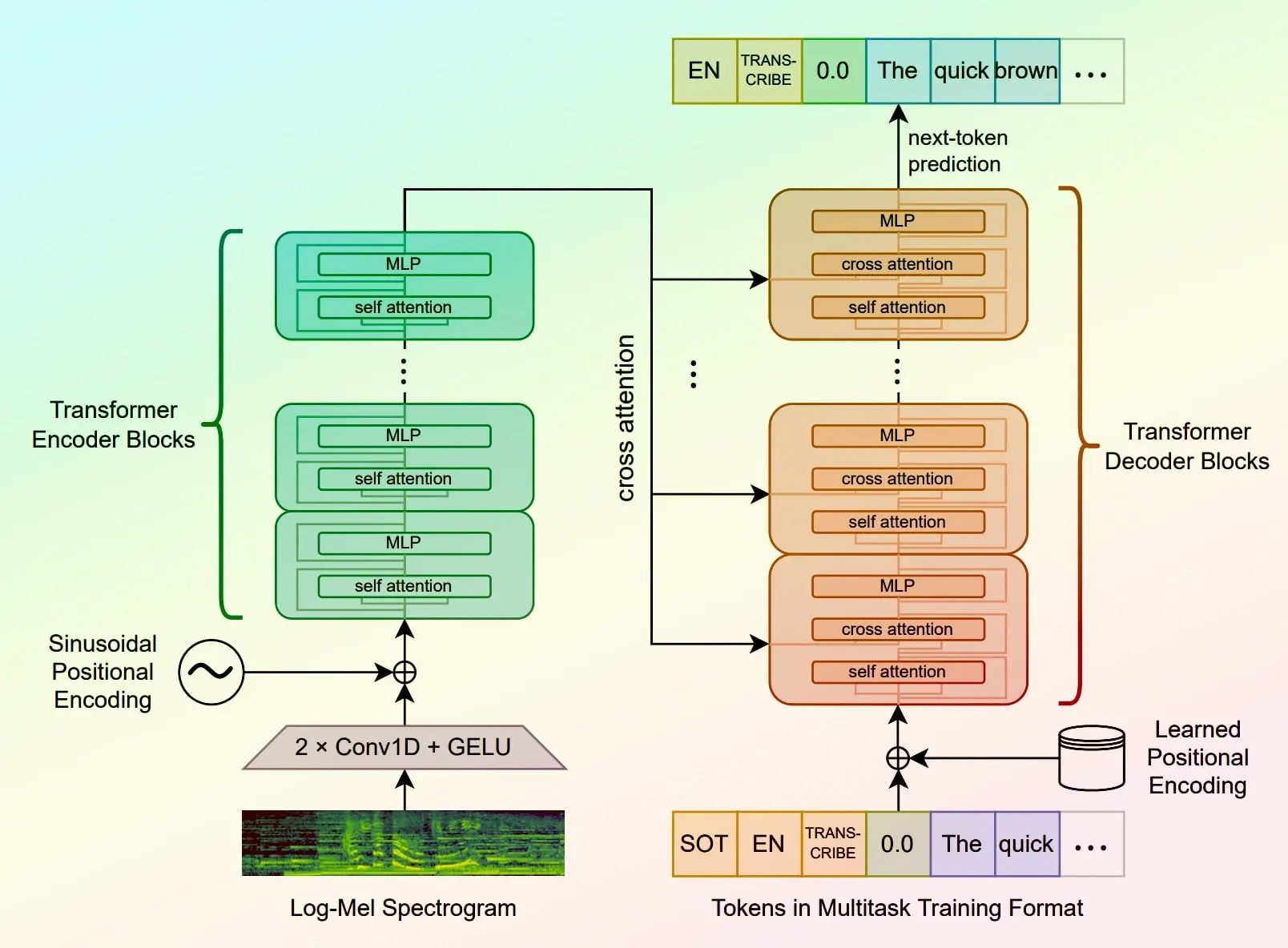

Turbo 不是新架构。它就是 Whisper Large-v3,解码器从 32 层剪枝到 4 层,然后微调恢复精度。编码器完全不变。

| Large-v3 Turbo | Large-v3 | |

|---|---|---|

| 参数量 | 809M | 1,550M |

| 解码器层数 | 4 | 32 |

| 语言数 | 99 | 99 |

| 翻译任务 | 不支持 | 支持 |

| 开源协议 | MIT | Apache 2.0 |

Turbo 的训练数据明确排除了翻译任务。完整版 Large-v3 支持翻译,但 Whisper Notes 只搭载 Turbo——翻译功能通过 Apple Intelligence 单独实现。

速度基准:Whisper Notes 在 Apple Silicon 上的表现

在 Mac 版 Whisper Notes 中,Turbo 通过 CoreML 在 Neural Engine 上运行。处理 10 分钟音频:

| 设备 | Whisper V3 | V3 Turbo | 提速 |

|---|---|---|---|

| iPhone 15 Pro | 425 秒 | 82 秒 | 5.2× |

| iPad Pro M2 | 380 秒 | 71 秒 | 5.4× |

| MacBook Pro M2 | 316 秒 | 63 秒 | 5.0× |

5 倍提速是 Whisper Notes 在 Apple Silicon 上的实测结果,较小的解码器在 Neural Engine 上优化效果更好。在 GPU 上使用 faster-whisper 等框架时,差距缩小到约 2.7 倍(见下方社区基准测试)。

精度对比:WER 词错率

Hugging Face Open ASR 排行榜在相同的英文数据集上测试了两个模型。Turbo 的词错率在每个基准上都与 V3 相差不到 0.5 个百分点:

| 数据集 | V3 Turbo WER | V3 WER |

|---|---|---|

| LibriSpeech Clean | 2.10% | 2.01% |

| LibriSpeech Other | 4.24% | 3.91% |

| GigaSpeech | 10.14% | 10.02% |

| Earnings22 | 11.63% | 11.29% |

| AMI | 16.13% | 15.95% |

| 平均 WER | 7.83% | 7.44% |

V3 在每个数据集上都略微更准,但差距很小——平均仅 0.39 个百分点。在实际使用中,基本感受不到区别。

在 YouTube-commons 长音频评估(最大的开源 ASR 基准之一)上,Turbo 的 WER 为 13.40%,V3 为 13.20%——但 Turbo 的实时因子达到 129.5×,而 V3 仅 55.3×。速度快 2.3 倍,精度几乎相同。

社区基准测试:GPU 与 CPU

来自 faster-whisper 和 whisper.cpp 社区的独立基准测试在不同硬件上显示了一致的结果。在 GPU 上使用 faster-whisper 转录 13 分钟音频:

| 模型 | 精度 | 耗时 | GPU 显存 | WER |

|---|---|---|---|---|

| Large-v3 Turbo | fp16 | 19.2 秒 | 2,537 MB | 1.92% |

| Large-v3 | fp16 | 52.0 秒 | 4,521 MB | 2.88% |

| Large-v3 Turbo | int8 | 19.6 秒 | 1,545 MB | 1.92% |

| Distil-Large-v3 | fp16 | 26.1 秒 | 2,409 MB | 2.39% |

数据来源:faster-whisper 在 NVIDIA GPU 上的基准测试,LibriSpeech clean 验证集。Turbo int8 仅需 1.5 GB 显存——2 GB 显卡也能跑。

在 RTX 3060 笔记本(6 GB 显存,int8 精度)上进行批量推理,优势更加明显:

| 模型 | 顺序推理 | 批量 (10) | 批量 WER |

|---|---|---|---|

| Large-v3 Turbo | 46.1 秒 | 18.7 秒 | 7.7% |

| Large-v3 | 230.8 秒 | 43.0 秒 | 7.9% |

| Large-v2 | 178.3 秒 | 43.2 秒 | 8.8% |

| Medium | 113.3 秒 | 26.3 秒 | 8.9% |

数据来源:NilaierMusic 基准测试,Intel i7-12650H + RTX 3060 笔记本 6 GB 显存,法语音频,int8 精度。

批量推理下,Turbo 在所有测试模型中 WER 最低(7.7%),同时速度最快。是生产环境的最佳选择。

已知局限(以及 Whisper Notes 的应对方案)

不支持翻译

Turbo 的训练数据不包含翻译任务,只能用源语言转录——不像 Large-v3 支持音频→英文翻译。

Whisper Notes — Mac 版通过 Apple Intelligence 自动将转录结果翻译为指定语言,实现双语对照显示,不依赖模型自身的翻译能力。

噪音环境下幻觉更多

社区反馈表明 Turbo 在极短音频片段或高噪音录音中,比 V3 更容易产生幻觉。这与解码器缩减(4 层 vs 32 层)有关。

Whisper Notes — 转录前自动运行 Pyannote VAD 语音活动检测,识别语音片段并去除静音和噪声,模型只处理真正的人声,显著减少幻觉。

该选哪个模型?

| 英语 / 欧洲语言 | Parakeet V3 — 比 Whisper 快 10 倍,精度更高 |

| 中文 / 日语 / 韩语 | SenseVoice — CJK 专用,52 倍速 |

| 其他语言 | Whisper Large V3 Turbo — 99 种语言,准确率高,速度慢 |